Si bien la ruptura de Washington con Anthropic expuso la total falta de reglas coherentes que gobiernen la inteligencia artificial, una coalición bipartidista de pensadores ha elaborado algo que la administración se ha negado hasta ahora a producir: un marco para cómo debería ser realmente el desarrollo responsable de la IA.

EL Declaración prohumana Se finalizó antes del enfrentamiento entre el Pentágono y Anthropic de la semana pasada, pero la colisión de los dos eventos no pasó desapercibida para ninguno de los involucrados.

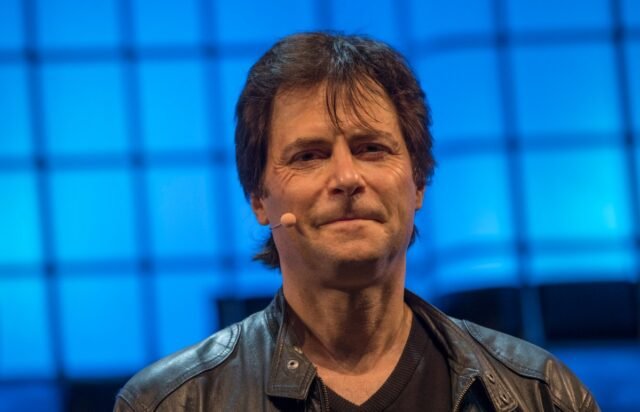

“Algo extraordinario ha sucedido en Estados Unidos tan sólo en los últimos cuatro meses”, dijo Max Tegmark, físico del MIT e investigador de inteligencia artificial que ayudó a organizar el esfuerzo. en conversacion con este editor. “Buscar de repente [is showing] que el 95% de todos los estadounidenses se oponen a una carrera no regulada hacia la superinteligencia”.

El documento publicado recientemente, firmado por cientos de expertos, ex funcionarios y figuras públicas, comienza con la aleccionadora observación de que la humanidad se encuentra en una bifurcación en el camino. Un camino, que la declaración llama “la carrera por el reemplazo”, lleva a que los humanos sean suplantados primero como trabajadores, luego como tomadores de decisiones, a medida que el poder se acumula en instituciones que no rinden cuentas y sus máquinas. El otro conduce a la IA que amplía enormemente el potencial humano.

Este último escenario depende de cinco pilares principales: mantener a los humanos a cargo, evitar la concentración de poder, proteger la experiencia humana, preservar la libertad individual y responsabilizar legalmente a las empresas de IA. Entre sus disposiciones más contundentes se encuentra una prohibición total del desarrollo de superinteligencia hasta que haya un consenso científico de que se puede hacer de manera segura y con una genuina aceptación democrática; paradas obligatorias en sistemas potentes; y una prohibición de arquitecturas que sean capaces de autorreplicación, superación autónoma o resistencia al cierre.

La publicación de la declaración coincide con un período que hace mucho más fácil evaluar su urgencia. El pasado viernes de febrero, el Secretario de Defensa, Pete Hegseth, designó a Anthropic –cuya IA ya se ejecuta en plataformas militares clasificadas– como un “riesgo para la cadena de suministro” después de que la compañía se negara a otorgar al Pentágono el uso ilimitado de su tecnología, una etiqueta normalmente reservada para empresas con vínculos con China. Horas más tarde, OpenAI llegó a su propio acuerdo con el Departamento de Defensa, un acuerdo que, según los expertos legales, será difícil de hacer cumplir de manera significativa. Lo que todo esto ha revelado es lo costosa que se ha vuelto la inacción del Congreso en materia de IA.

Como Dean Ball, miembro principal de la Fundación para la Innovación Estadounidense, dijo al New York Times Luego, “Esto no es sólo una disputa sobre un contrato. Esta es la primera conversación que hemos tenido como país sobre el control de los sistemas de IA”.

Evento tecnológico

San Francisco, California

|

13-15 de octubre de 2026

Tegmark buscó una analogía que la mayoría de la gente pueda entender cuando hablamos. “Nunca hay que preocuparse de que una compañía farmacéutica presente algún otro medicamento que cause un daño enorme antes de que la gente haya descubierto cómo hacerlo seguro”, dijo, “porque la FDA no les permitirá liberar nada hasta que sea lo suficientemente seguro”.

Las guerras territoriales en Washington rara vez generan el tipo de presión pública que cambie las leyes. En cambio, Tegmark ve la seguridad infantil como el punto de presión que más probablemente resolverá el estancamiento actual. De hecho, la declaración exige pruebas obligatorias previas al despliegue de los productos de IA (especialmente chatbots y aplicaciones complementarias dirigidas a usuarios más jóvenes) que cubran riesgos que incluyen un aumento de las ideas suicidas, la exacerbación de problemas de salud mental y la manipulación emocional.

“Si un anciano espeluznante le envía mensajes de texto a un niño de 11 años haciéndose pasar por una niña y trata de persuadirlo para que se suicide, el tipo podría ir a la cárcel por eso”, dijo Tegmark. “Ya tenemos leyes. Es ilegal. Entonces, ¿por qué es diferente si lo hace una máquina?”

Cree que una vez que se establezca el principio de las pruebas previas al lanzamiento de productos para niños, el alcance casi inevitablemente se ampliará. “La gente vendrá y dirá, agreguemos algunos otros requisitos. Quizás también deberíamos probar si esto puede ayudar a los terroristas a fabricar armas biológicas. Quizás deberíamos probar para asegurarnos de que la superinteligencia no tenga la capacidad de derrocar al gobierno de Estados Unidos”.

No es poca cosa que el ex asesor de Trump, Steve Bannon, y Susan Rice, asesora de seguridad nacional del presidente Obama, firmaran el mismo documento, junto con el ex presidente del Estado Mayor Conjunto, Mike Mullen, y líderes religiosos progresistas.

“En lo que están de acuerdo, por supuesto, es en que todos son humanos”, dice Tegmark. “Si la pregunta es si queremos un futuro para los humanos o un futuro para las máquinas, por supuesto que estarán del mismo lado”.