UNOLa lucha en curso de nthropic con el Departamento de Defensa sobre qué restricciones de seguridad él puede poner su inteligencia artificial Los modelos cautivaron a la industria tecnológica, actuando como una prueba de cómo se puede utilizar la IA en la guerra y del poder del gobierno para obligar a las empresas a cumplir con sus demandas.

Las negociaciones giraron en torno a la negativa de Anthropic a permitir que el gobierno federal Usa tu Claude AI para vigilancia nacional masiva o sistemas de armas autónomos, pero la disputa también refleja la naturaleza desordenada de lo que sucede cuando las empresas de tecnología integran sus productos en los conflictos. Esta semana, el Pentágono declaró a Anthropic un riesgo para la cadena de suministro por su negativa a aceptar los términos del gobierno, mientras que Anthropic ha prometido impugnar la designación en los tribunales.

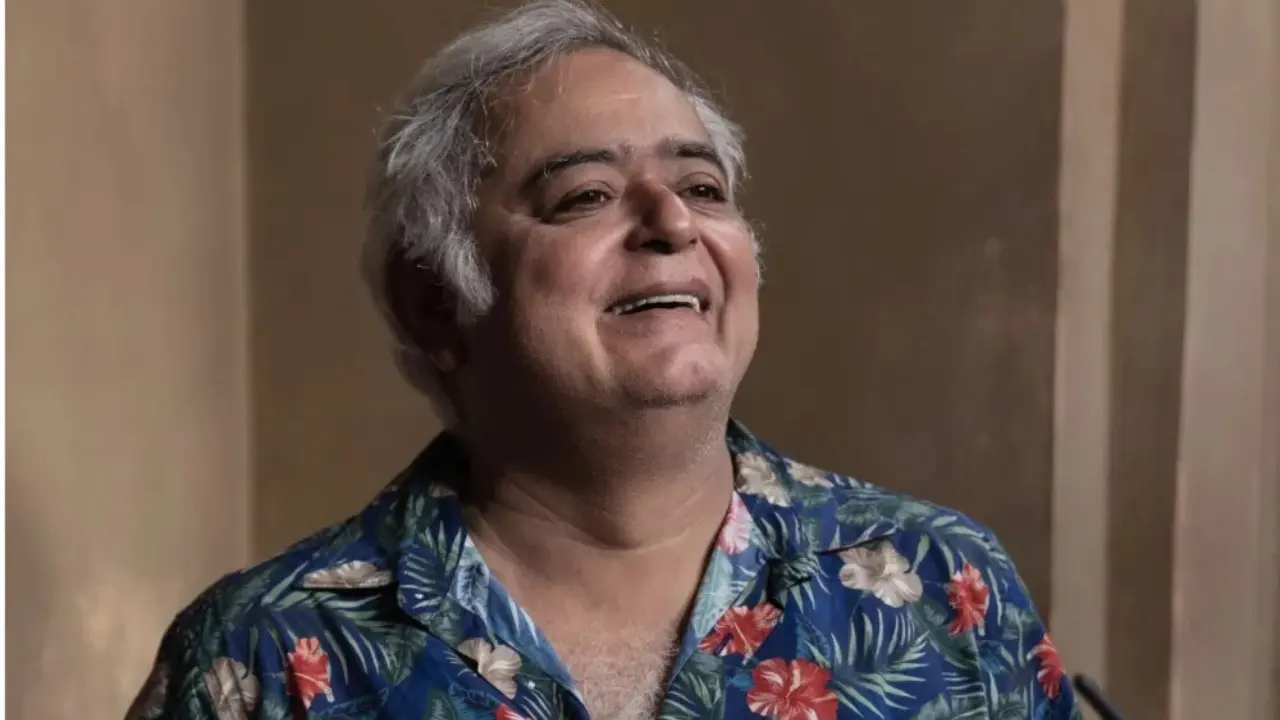

The Guardian habló con Sarah Kreps, profesora y directora del Instituto de Política Tecnológica de la Universidad de Cornell, quien anteriormente sirvió en la Fuerza Aérea de los Estados Unidos, sobre cómo se desarrolló la rivalidad.

tu trabajaste por un tiempo en cuestiones relacionadas con la “tecnología de doble uso”“. ¿Qué pasa cuando hay una tecnología de consumo que también se utiliza con fines secretos o militares?

He estado pensando mucho en esto porque estaba en el ejército y estaba del lado de los soldados que estaban desarrollando y adquiriendo nuevas tecnologías. Siempre recibíamos críticas sobre por qué tomó tanto tiempo y ahora, viendo lo que está sucediendo, me doy cuenta de por qué toma tanto tiempo.

Lo que desarrollaría para contextos militares y clasificados es muy diferente de lo que Anthropic ha desarrollado al utilizar Claude. El desafío para los militares es que estas tecnologías son tan útiles que no pueden esperar hasta que esté disponible una versión de grado militar. Necesitan actuar rápidamente dado el valor de estas herramientas, pero no es sorprendente que hayan encontrado diferencias culturales no solo entre una plataforma de IA y el ejército, sino también entre una plataforma de IA que ha tratado de cultivar una reputación de ser más consciente de la seguridad.

Uno elemento en esta rivalidad es que Anthropic se llama a sí mismo una empresa orientada a la seguridad, pero luego firmó un acuerdo con los militares.

Sí, es sorprendente que Anthropic se sorprenda de hacia dónde va esto. Parte del desafío es que Anthropic parece haber tomado la decisión hace uno o dos años de que Chat GPT sería para usuarios individuales y Anthropic intentaría dominar el mercado corporativo. Esto significa que están intentando hacer negocios con organizaciones en lugar de intentar vender planes individuales.

El enigma para mí es que entonces estaban haciendo negocios con el Pentágono y Palantir, que se dedica a utilizar la IA para fines que algunas personas dirían que son cuestionables. Así que esta decisión me sorprendió porque estaba en desacuerdo con la marca que Anthropic estaba tratando de seleccionar.

Parece que Anthropic era Está bien con un uso bastante amplio de su tecnología, pero hubo una línea roja que han alcanzado con vigilancia doméstica masiva y armas letales autónomas.

Hay algunas posibilidades. Una es que parte de esto tenía que ver con las relaciones entre la gente de Anthropica y Administración Trumplo que condujo a una espiral descendente de desconfianza.

En segundo lugar, estaba la situación en Venezuela y luego la política que rodea las actividades de ICE. Cabe preguntarse ¿qué significa realmente utilizar estas tecnologías de forma legal? La definición de legalidad de una persona puede ser muy diferente de la de otra.

El argumento del Pentágono fue, en parte, que si hay una cuestión de defensa nacional no deberíamos tener que llamar Dario Amodei para obtener la aprobación. Parece haber aquí una verdadera pregunta sobre qué papel tienen las empresas privadas de tecnología en la toma de decisiones de seguridad nacional.

Si recuerdas el caso de El iPhone del asesino de San BernardinoA las autoridades les preocupaba que se tratara de una situación de bomba de tiempo y necesitaban que Apple se pusiera al teléfono. [In 2016, the FBI demanded Apple create a backdoor to grant them access to a mass shooter’s phone. Apple refused on privacy grounds, resulting in the FBI seeking out an independent third party to hack into the device].

La diferencia aquí con la IA de Anthropic es que una vez que la entregas al ejército, ya no necesitas la aprobación de Anthropic para usarla como mejor te parezca. Es la diferencia entre hardware y software. Se puede reutilizar ese software y utilizarlo de maneras que quizás no formaban parte del acuerdo explícito, pero ahora se puede justificar basándose en la seguridad nacional. Entonces Anthropic ha perdido toda su influencia porque está en manos de estos profesionales de seguridad nacional.

Y Anthropic no podría decir para qué se usa, ¿verdad?

Sí, exactamente correcto. No solo entra en una caja negra, sino también en Black Ops y sistemas clasificados que están cerrados.

Esta semana me pareció interesante que muchas preguntas de larga data sobre el uso de la IA en el ejército están llegando a un punto crítico. Llevas mucho tiempo siguiendo estos temas, ¿qué te parece ver esta pelea actual?

Cuando escuché hablar al director ejecutivo de Anthropic, habló sobre estos riesgos existenciales y la apropiación indebida de la IA para el bioterrorismo. Siempre pensé que estaban demasiado lejos o fuera de mi alcance. Pensé que este tipo de caso más mundano era más riesgoso.

También hay gente que lleva mucho tiempo prediciendo estas cuestiones sobre las armas autónomas. El desafío es cómo saber si realmente hay un ser humano en el circuito. Esta fue una preocupación para Anthropic: ¿cómo sabemos si estos sistemas se utilizan de forma completamente autónoma? Estados Unidos dice que no utilizaremos la IA de forma totalmente autónoma, pero no está claro cómo será ese proceso para garantizar que eso no suceda. Esto llevaría algún tiempo, pero creo que era inevitable que avanzáramos en esta dirección, simplemente porque la tecnología se está volviendo cada vez más sofisticada. El hecho de que ahora esté involucrado en un conflicto no hace más que acelerar estos plazos.

Hablamos mucho sobre las amenazas de la IA y estas líneas rojas que la gente ha dejado atrás, pero ¿cómo se utiliza ya la IA en la guerra?

Puedes ver cómo esto es extremadamente útil en un entorno militar. Trabajé un poco en el lado de la inteligencia y uno de los desafíos no es la falta de contenido, sino la relación señal-ruido. Tienes una gran cantidad de información, pero puede ser muy difícil conectar los puntos, y eso es algo en lo que la IA es muy buena. Le suministras grandes cantidades de información y genera resultados que te ayudan a identificar cuál es la señal.

Si busca reconocimiento de patrones, la IA es realmente buena en el reconocimiento de patrones. Puede identificar cuáles son los tipos de correlatos o características que está buscando y luego puede salir e identificar cosas, por ejemplo, un barco de la marina iraní, basándose en lo que usted programó para identificar. Esto no ha sido muy controvertido en algunos aspectos porque estos objetivos son bastante concretos.

La gente se siente más incómoda en un escenario en el que Estados Unidos, por ejemplo, llevaría a cabo ataques antiterroristas. Tienes a un individuo en tu lugar que no tiene muchas características identificables, por lo que esa es una situación mucho más precaria para la IA, donde realmente querrás asegurarte de realizar una verificación triple. Podría ser un combatiente, podría ser un civil. No se trata de un buque de guerra ni de un misil tierra-aire, donde es más difícil fallar.