La administración Trump está cumpliendo su amenaza de designar a la empresa de inteligencia artificial Anthropic como un riesgo para la cadena de suministro, en una medida sin precedentes que podría obligar a otros proveedores de servicios gubernamentales a dejar de utilizar el chatbot de IA Claude.

El Pentágono dijo en un comunicado el jueves que ha “informado oficialmente a los líderes de Anthropic que la empresa y sus productos se consideran un riesgo para la cadena de suministro, con efecto inmediato”.

La decisión pareció poner fin a la oportunidad de seguir negociando con Anthropic, casi una semana después de que el presidente Donald Trump y el secretario de Defensa, Pete Hegseth, acusaran a la empresa de poner en peligro la seguridad nacional.

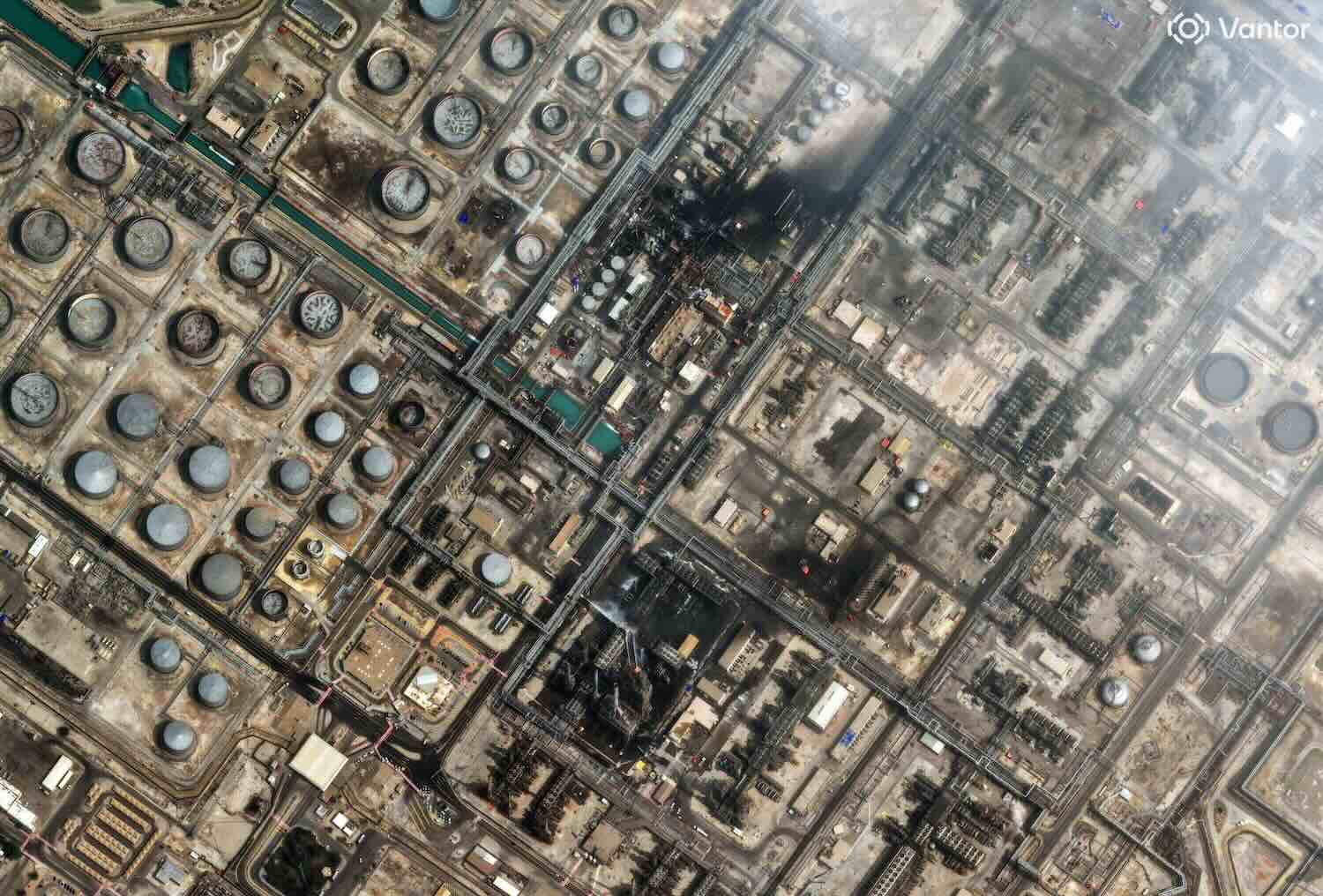

Trump y Hegseth anunciaron una serie de amenazas de castigo el viernes pasado, el día anterior la guerra en irandespués de que el director ejecutivo de Anthropic, Dario Amodei, se negara a dar marcha atrás por preocupaciones de que los productos de la compañía pudieran usarse para la vigilancia masiva de estadounidenses o armas autónomas.

La compañía con sede en San Francisco no respondió de inmediato a una solicitud de comentarios el jueves. Anteriormente prometió demandar si el Pentágono llevaba a cabo lo que la empresa describió como una acción “legalmente infundada” “nunca antes aplicada públicamente a una empresa estadounidense”.

La declaración del Pentágono decía que “este es un principio fundamental: que los militares puedan utilizar la tecnología para todos los fines legales. Los militares no permitirán que un proveedor se inserte en la cadena de mando, restringiendo el uso legal de una capacidad crítica y poniendo en riesgo a nuestros combatientes”.

Algunos contratistas militares ya estaban cortando lazos con Anthropic, una estrella en ascenso en la industria tecnológica que vende Claude a una variedad de empresas y agencias gubernamentales. Lockheed Martin dijo que “seguirá la orientación del Presidente y del Departamento de Guerra” y buscará otros proveedores de grandes modelos lingüísticos.

“Esperamos impactos mínimos ya que Lockheed Martin no depende de ningún proveedor de LLM para ninguna parte de nuestro trabajo”, dijo la compañía. Aún no está claro si la designación tiene como objetivo bloquear el uso de Anthropic por parte de todos los contratistas del gobierno federal o sólo de aquellos que se asocian con el ejército.

La decisión del Pentágono de hacer cumplir una norma diseñada para abordar las amenazas al suministro planteadas por adversarios extranjeros fue rápidamente recibida con críticas tanto de opositores como de algunos partidarios de la administración republicana de Trump. Los códigos federales han definido el riesgo de la cadena de suministro como un “riesgo de que un adversario pueda sabotear, introducir maliciosamente funciones no deseadas o subvertir de otro modo” un sistema para interrumpirlo, degradarlo o espiarlo.

La senadora estadounidense Kirsten Gillibrand, demócrata de Nueva York y miembro del Comité de Servicios Armados del Senado y del Comité de Inteligencia del Senado, lo calificó como “un uso indebido peligroso de una herramienta destinada a apuntar a la tecnología controlada por el adversario”.

“Esta acción imprudente es miope, contraproducente y un regalo para nuestros adversarios”, dijo en una declaración escrita el jueves.

Neil Chilson, ex jefe tecnólogo republicano de la Comisión Federal de Comercio que ahora dirige la política de IA en el Abundance Institute, dijo que la decisión parece “una extralimitación masiva que dañaría tanto al sector de IA de Estados Unidos como a la capacidad del ejército de adquirir la mejor tecnología para el combatiente estadounidense”.

Más temprano ese mismo día, un grupo de ex funcionarios de defensa y seguridad nacional envió una carta a los legisladores estadounidenses expresando “serias preocupaciones” sobre la designación.

“El uso de esta autoridad contra una corporación nacional estadounidense es una desviación profunda de su propósito previsto y sienta un precedente peligroso”, decía la carta de ex funcionarios y expertos en políticas, incluido el ex director de la CIA Michael Hayden y líderes retirados de la Fuerza Aérea, el Ejército y la Marina.

Agregaron que tal designación tiene como objetivo “proteger a los Estados Unidos de la infiltración de adversarios extranjeros, de empresas en deuda con Beijing o Moscú, no de innovadores estadounidenses que operan de manera transparente bajo el Estado de derecho. Aplicar esta herramienta para penalizar a una empresa estadounidense por negarse a eliminar las salvaguardias contra la vigilancia interna masiva y las armas totalmente autónomas es un error de categoría con consecuencias que se extienden mucho más allá de esta disputa”.

Al perder sus principales asociaciones con contratistas de defensa, Anthropic experimentó un aumento en las descargas de los consumidores la semana pasada debido a que la gente apoyaba su postura moral. Anthropic se jactó de que más de un millón de personas se registraron en Claude todos los días de esta semana, superando a ChatGPT de OpenAI y Gemini de Google como la principal aplicación de IA en más de 20 países en la tienda de aplicaciones de Apple.

La disputa con el Pentágono también ha profundizado aún más la amarga rivalidad de Anthropic con OpenAI, que anunció un acuerdo el viernes con el Pentágono para reemplazar efectivamente a Anthropic con ChatGPT en entornos militares clasificados.

OpenAI dijo que buscaba protecciones similares contra la vigilancia nacional y las armas totalmente autónomas, pero luego tuvo que cambiar sus acuerdos, lo que llevó al director ejecutivo Sam Altman a decir que no debería haberse apresurado a llegar a un acuerdo que “parecía oportunista y descuidado”.