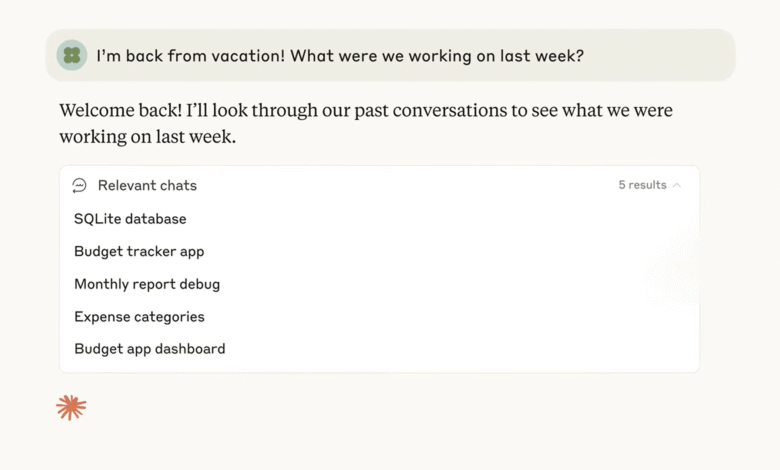

Ahora puede darle acceso a Claude a recuerdos de conversaciones anteriores, pero solo si desea

- Claude Chatbot de Anthrope ahora tiene una función de memoria a pedido

- La IA recordará los chats pasados solo cuando un usuario pregunte específicamente

- La característica se está implementando primero con los suscriptores de Max, Team y Enterprise antes de expandirse a otros planes

Anthrope le ha dado a Claude una actualización de memoria, pero solo se activará cuando lo elija. La nueva característica le permite a Claude recordar conversaciones pasadas, proporcionando la IA chatbot con información para ayudar a continuar con proyectos anteriores y aplicar lo que ha discutido antes en su próxima conversación.

La actualización está llegando a los suscriptores Max, Team y Enterprise de Claude primero, aunque probablemente estará más ampliamente disponible en algún momento. Si lo tiene, puede pedirle a Claude que busque mensajes anteriores vinculados a su espacio de trabajo o proyecto.

Sin embargo, a menos que pregunte explícitamente, Claude no arrojará un ojo hacia atrás. Eso significa que Claude mantendrá un tipo genérico de personalidad por defecto. Eso es por el bien de la privacidad, según antrópico. Claude puede recordar sus discusiones si lo desea, sin arrastrarse en su diálogo sin invitación.

En comparación, AAIP de Opic almacena automáticamente chats pasados a menos que opte por no participar y los usa para dar forma a sus respuestas futuras. Google Géminis Va aún más, empleando sus conversaciones con la IA y su historial de búsqueda y los datos de la cuenta de Google, al menos si lo deja. El enfoque de Claude no recoge las migas de pan que hace referencia a conversaciones anteriores sin que lo pida que lo haga.

Claude recuerda

Agregar memoria puede no parecer un gran problema. Aún así, sentirá el impacto de inmediato si alguna vez ha intentado reiniciar un proyecto interrumpido por días o semanas sin un asistente útil, digital o de otra manera. Hacer que sea una elección de suscripción es un buen toque para acomodar cuán cómodas son las personas con IA actualmente.

Muchos pueden querer ayuda de IA sin entregar el control a los chatbots que nunca olvidan. Claude side esa tensión limpiamente haciendo memoria algo que convocas deliberadamente.

Pero no es magia. Dado que Claude no conserva un perfil personalizado, no le recordará de manera proactiva prepararse para los eventos mencionados en otros chats o anticipar los cambios de estilo al escribir a un colega versus una presentación comercial pública, a menos que se solicite a la mitad de la conversación.

Además, si hay problemas con este enfoque de la memoria, la estrategia de implementación de Anthrope permitirá a la compañía corregir cualquier error antes de que esté ampliamente disponible para todos los usuarios de Claude. También valdrá la pena ver si la creación de un contexto a largo plazo como ChatGPT y Gemini lo están haciendo será más atractivo o desagradable para los usuarios en comparación con la forma de Claude de hacer que la memoria sea un aspecto a pedido de usar el chatbot AI.

Y eso supone que funciona perfectamente. La recuperación depende de la capacidad de Claude para surgir los extractos correctos, no solo el chat más reciente o más largo. Si los resúmenes son confusos o el contexto es incorrecto, podría terminar más confundido que antes. Y aunque la fricción de tener que pedirle a Claude que use su memoria es un beneficio, todavía significa que tendrá que recordar que la característica existe, lo que algunos pueden encontrar molesto. Aun así, si el antrópico tiene razón, un pequeño límite es algo bueno, no una limitación. Y los usuarios estarán contentos de que Claude recuerde que, y nada más, sin una solicitud.