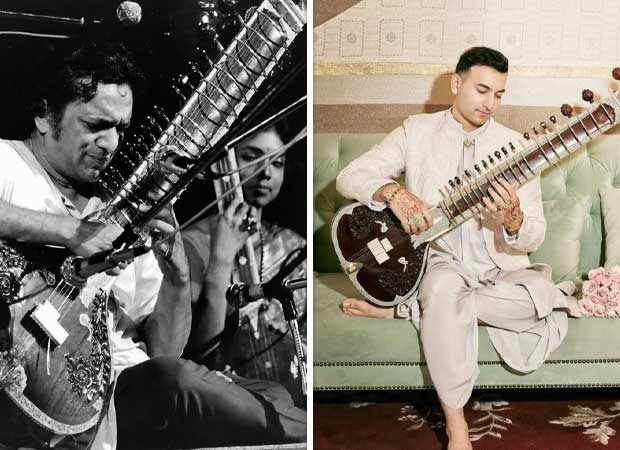

Director general de Anthropo, Darío Amodei. Archivo | Crédito de la foto: ANI.

La empresa de inteligencia artificial Anthropic dijo el jueves (26 de febrero de 2026) que no daría al Departamento de Defensa de EE.UU. el uso ilimitado de su tecnología a pesar de haber sido presionado para cumplir por el Pentágono.

“Estas amenazas no cambian nuestra posición: no podemos, en conciencia, acceder a su petición”, dijo el director ejecutivo de Anthropic, Dario Amodei, en un comunicado.

Washington le dio a la startup de inteligencia artificial hasta el viernes (27 de febrero de 2026) para aceptar el uso militar incondicional de su tecnología, incluso si al hacerlo viola los estándares éticos de la compañía o se ve obligada a cumplir con los poderes federales de emergencia.

Amodei dijo que el Pentágono y las agencias de inteligencia han utilizado modelos antropogénicos para defender el país, pero que trazan una línea ética con respecto a su uso para la vigilancia masiva de ciudadanos estadounidenses y armas totalmente autónomas.

“El uso de estos sistemas para una vigilancia interna masiva es incompatible con los valores democráticos”, afirmó Amodei.

Añadió que todavía no se puede “confiar en los principales sistemas de inteligencia artificial para impulsar armas mortales sin que un ser humano tenga el control final”.

“No suministraremos conscientemente un producto que ponga en riesgo a los combatientes y civiles estadounidenses”.

Después de reunirse con Anthropic a principios de esta semana, el Pentágono presentó un duro ultimátum: aceptar el uso militar sin restricciones de su tecnología antes de las 5:01 pm (22:01 GMT) del viernes (27 de febrero de 2026) o enfrentarse a ser obligado a cumplir con la Ley de Producción de Defensa.

La ley de la época de la Guerra Fría, utilizada por última vez durante la pandemia de Covid, otorga al gobierno federal amplios poderes para obligar a la industria privada a priorizar las necesidades de seguridad nacional.

El Pentágono también amenazó con etiquetar a Antropica como un riesgo para la cadena de suministro, una designación típicamente reservada para empresas de países adversarios que podría dañar gravemente la capacidad de la empresa para trabajar con el gobierno de Estados Unidos y su reputación.

En ese momento, un alto funcionario del Pentágono desestimó las preocupaciones de la empresa, insistiendo en que el Departamento de Defensa siempre había actuado dentro de la ley.

“La legalidad es responsabilidad del Pentágono como usuario final”, dijo el funcionario, y agregó que el departamento “sólo emitió órdenes legales”.

Las autoridades también confirmaron que se produjo un intercambio de misiles balísticos intercontinentales entre Anthropic y el Pentágono, subrayando la sensibilidad de las aplicaciones en el centro de la disputa.

El Pentágono confirmó que el sistema Grok de Elon Musk ha sido autorizado para su uso en un entorno clasificado, mientras que otros contratistas (OpenAI y Google) fueron descritos como cercanos a autorizaciones similares, lo que aumenta la presión competitiva sobre Anthropic para que se alinee.

Anthropic fue contratada junto con estas empresas el año pasado para proporcionar modelos de inteligencia artificial para una variedad de aplicaciones militares en virtud de un acuerdo de 200 millones de dólares.

Ex empleados de OpenAI fundaron Anthropic en 2021 con la premisa de que el desarrollo de la IA debe priorizar la seguridad, una filosofía que ahora la pone en curso de colisión con el Pentágono y la Casa Blanca.

“Anthropic entiende que el Departamento de Guerra, no las empresas privadas, toma las decisiones militares”, dijo Amodei.

“Sin embargo, en un conjunto limitado de casos, creemos que la IA puede socavar, en lugar de defender, los valores democráticos”.

Publicado – 27 de febrero de 2026, 07:14 a. m. IST