Actualmente, todos los laboratorios de IA de última generación están racionando dos cosas: la electricidad y la informática. La mayoría compra sus modelos de ordenadores de entrenamiento al mismo proveedor, con márgenes brutos exorbitantes que han convertido a Nvidia en una de las empresas más valiosas del mundo. Google no lo hace.

El martes por la noche, en una reunión privada en el F1 Plaza de Las Vegas, Google presentó una vista previa de sus unidades de procesamiento de tensores de octava generación. La propuesta: dos diseños de silicio personalizados que se lanzarán a finales de este año, cada uno desarrollado específicamente para una mitad diferente de la carga de trabajo moderna de IA. El TPU 8t apunta al entrenamiento para modelos de frontera, y el TPU 8i apunta al mundo de la inferencia y el muestreo de agentes en tiempo real, de baja latencia y con uso intensivo de memoria.

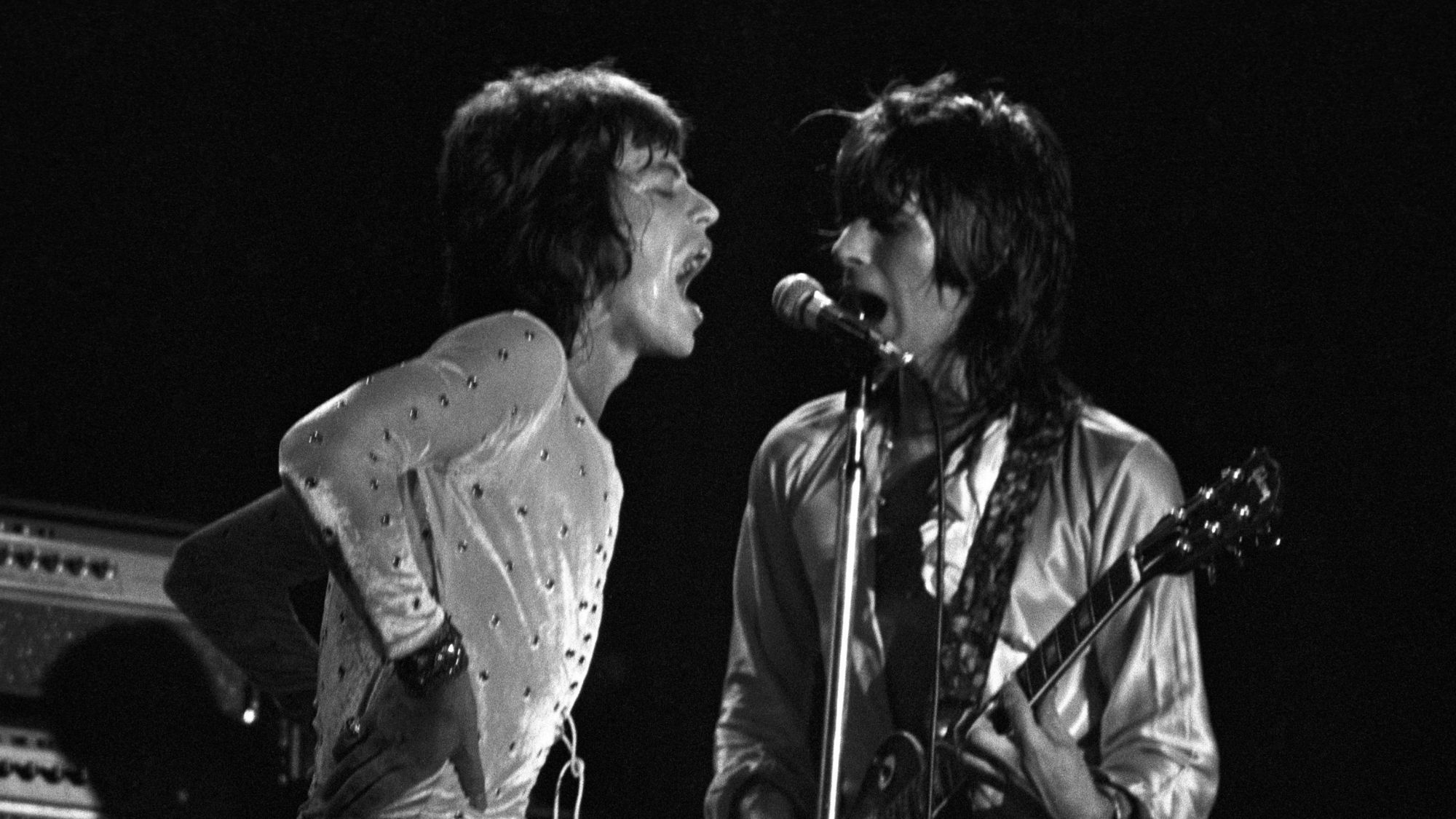

Amin Vahdat, vicepresidente senior de Google y tecnólogo jefe de infraestructura e inteligencia artificial (en la foto arriba a la izquierda), usó su tiempo en el escenario para resaltar un punto que es más importante para los compradores empresariales que cualquier especificación individual: Google diseña cada capa de su pila de inteligencia artificial de extremo a extremo, y esa integración vertical está comenzando a reflejarse en ahorros de costo por token que Google dice que sus rivales no pueden igualar.

“Un chip al año no era suficiente”: Dentro de la apuesta de Google para 2024 por una hoja de ruta de dos chips

La historia más interesante detrás de v8t y v8i es cuando se tomó la decisión de dividir la hoja de ruta. El llamado se produjo en 2024, según Vahdat, un año antes de que la industria en general recurra a modelos de razonamiento, agentes y aprendizaje por refuerzo como la carga de trabajo de frontera dominante.

En ese momento, fue una lectura contraria. “Hace dos años nos dimos cuenta de que un chip al año no sería suficiente”, dijo Vahdat durante la tarde. “Esta es nuestra primera oportunidad de utilizar dos chips especializados de muy alta potencia”.

Para los compradores de empresas, las implicaciones son concretas. Clientes que realizan ajustes o capacitación a gran escala en Google Cloud y clientes que atienden a agentes de producción en IA de vértice He estado alquilando los mismos aceleradores y comiendo la ineficiencia. V8 es la primera generación en la que el propio silicio trata estos problemas de forma diferente con dos conjuntos de chips.

TPU 8t: una estructura de entrenamiento que puede alcanzar un millón de chips

Sobre el papel, el TPU 8t es un agresivo paso generacional. Según Google, 8t ofrece 2,8 veces los EFlops FP4 por módulo (121 frente a 42,5) respecto a Ironwood, la TPU de séptima generación que se lanzará en 2025, duplica el ancho de banda de expansión bidireccional a 19,2 Tb/s por chip y cuadriplica la red de expansión a 400 Gb/s por chip. El tamaño del pod crece modestamente de 9.216 a 9.600 chips, mantenidos unidos por la topología 3D Torus de Google.

El número que más importa a los líderes de TI que evalúan dónde realizar capacitación a escala de frontera: los clústeres de 8t (Superpods) pueden escalar más de 1 millón de chips TPU en un solo trabajo de capacitación a través de una nueva interconexión que Google llama red Virgo.

8t también presenta TPU Direct Storage, que mueve datos desde el nivel de almacenamiento administrado de Google directamente a HBM sin los saltos habituales mediados por la CPU. Para ejecuciones de entrenamiento largas donde el tiempo del reloj es el factor de costo, colapsar esta ruta de datos reduce la cantidad de horas de pod necesarias para finalizar cada época.

TPU 8i y Boardfly: reingeniería de la red para agentes

Si el 8t es un paso evolutivo, el TPU 8i es el chip con mayor interés arquitectónico. Aquí es también donde la historia para los compradores de TI se vuelve más convincente.

Los saltos en las especificaciones año tras año son, como dijo Vahdat, “impresionantes”. Según Google, el 8i ofrece 9,8 veces los EFlops FP8 por pod (11,6 frente a 1,2), 6,8 veces la capacidad de HBM por pod (331,8 TB frente a 49,2) y un tamaño de pod que crece 4,5 veces de 256 a 1152 chips.

Lo que impulsó estas cifras fue repensar la propia red. Vahdat explicó la idea directamente: la forma estándar de Google de conectar chips admitía ancho de banda en lugar de latencia, lo que es bueno para mover grandes cantidades de datos, no diseñado para el tiempo mínimo que se necesita para obtener una respuesta. Este perfil sirve para la formación. Para los agentes esto no sucede. En asociación con Google DeepMind, el equipo de TPU creó lo que Google llama una topología Boardfly específicamente para reducir el diámetro de la red, disminuyendo la cantidad de saltos entre dos chips cualesquiera en un pod. Junto con un motor de aceleración colectiva y lo que Google describe como SRAM en chip muy grande, el 8i ofrece una mejora de 5 veces en la latencia para muestreo LLM en tiempo real y aprendizaje por refuerzo.

La brecha de integración vertical: por qué Google no pagará el “impuesto Nvidia”

El subtexto de la presentación de Vahdat fue un diagrama de seis capas que Google llama la pila de IA: energía en la parte inferior, luego terreno y recintos del centro de datos, hardware de infraestructura de IA, software de infraestructura de IA, modelos (Gemini 3) y servicios en la parte superior. Vahdat señaló que diseñar cada capa de forma aislada obliga al mínimo común denominador para cada capa. Google los diseña juntos.

Aquí es donde cristaliza la historia competitiva para los compradores y analistas de TI. OpenAI, Anthropic, xAI y Meta dependen en gran medida del silicio de Nvidia para entrenar sus modelos de frontera. Cada GPU H200 y Blackwell que compran trae consigo el margen bruto del centro de datos de Nvidia: el “impuesto Nvidia” informal que los analistas de la industria han señalado durante dos años consecutivos como una desventaja de costos estructurales para quienes alquilan en lugar de diseñar. Google paga los costos de fabricación, embalaje e ingeniería de sus TPU. No pagas ese margen.

Qué significa v8 para la carrera informática: una nueva lista de verificación de evaluación para líderes de TI

Para los equipos de adquisiciones e infraestructura, TPUv8 replantea la evaluación de la nube 2026-2027 de manera concreta.

Los equipos que entrenan grandes modelos propietarios deben considerar ventanas de disponibilidad de 8t, acceso a la red Virgo y SLA de buena calidad, no solo EFlops centrales. Los equipos que atienden a agentes o cargas de trabajo de razonamiento deben evaluar la disponibilidad de 8i en Vertex AI, los puntos de referencia de latencia independientes a medida que surgen y si el escalado de HBM por pod se ajusta a sus ventanas de contexto. Los equipos que consumen Gemini a través de Gemini Enterprise deberían heredar el 8i lift y esperar que el límite superior de lo que pueden implementar en producción aumente significativamente para 2026.

Las advertencias son reales. La disponibilidad general todavía es “finales de 2026”. v8 es una señal de hoja de ruta, no una decisión de adquisición hoy. Los puntos de referencia de Google son autoinformados; Sin duda, las cifras independientes provendrán de los primeros clientes de la nube y de evaluadores externos durante los próximos dos trimestres. Y la portabilidad entre JAX/XLA y el ecosistema CUDA/PyTorch sigue siendo un costo de fricción que vale la pena considerar al negociar cualquier compromiso de varios años.

Mirando más allá, Vahdat hizo dos predicciones dignas de mención. En primer lugar, las CPU de uso general resurgirán dentro de los sistemas de IA, no como aceleradores, sino como computación de orquestación para entornos aislados de agentes, máquinas virtuales y ejecución de herramientas. En segundo lugar, la especialización, enmarcada explícitamente como un pronóstico de la industria más que como una vista previa de la hoja de ruta de Google, también sigue siendo fuerte. A medida que las CPU de uso general se estabilizan en un pequeño porcentaje anual, las cargas de trabajo críticas requerirán silicio diseñado específicamente. “Dos chips podrían convertirse en más”, dijo Vahdat, sin especificar si “más” significaría futuras variantes de TPU u otras clases de aceleradores especializados.

La carrera por la frontera informática solía ser una cuestión de quién podía comprar más H100. Ahora es una cuestión de quién controla la pila. La lista de empresas que realmente hacen esto es, por el momento, dos: Google y Nvidia.