El Departamento de EE.UU. Ministerio de Defensa parece estar castigando ilegalmente a Antrópica por intentar restringir el uso de sus herramientas de inteligencia artificial por parte del ejércitodijo la jueza de distrito estadounidense Rita Lin durante una audiencia el martes.

“Parece un intento de paralizar a Anthropic”, dijo Lin sobre el hecho de que el Pentágono haya designado a la empresa como un riesgo para la cadena de suministro. “Parece [the department] está castigando a Anthropic por intentar llevar el escrutinio público a esta disputa contractual, lo que obviamente sería una violación de la Primera Enmienda”.

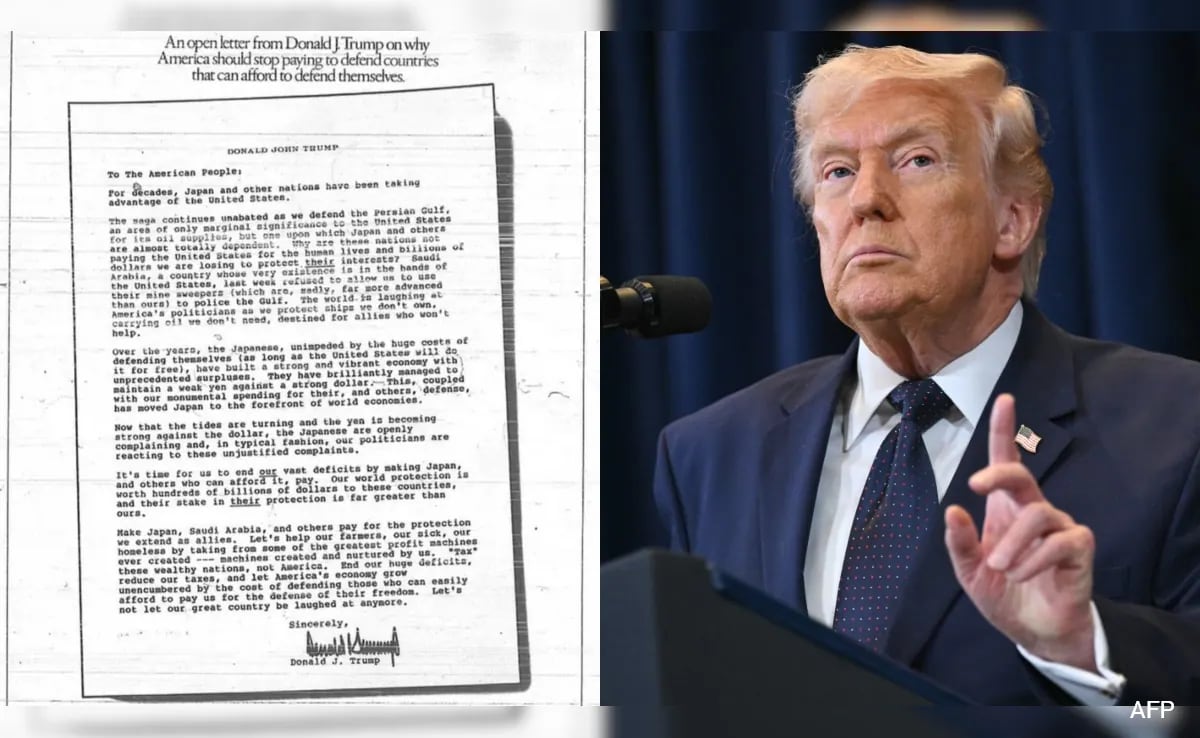

antrópico presentó dos demandas federales alegando que la decisión de la administración Trump de designar a la empresa como un riesgo para la seguridad equivalía a una represalia ilegal. El gobierno le dio una palmada a la etiqueta de Anthropic después de presionar para imponer limitaciones sobre cómo el ejército podría utilizar su IA. La audiencia del martes tuvo lugar en un caso abierto en San Francisco.

Antropica solicita una orden temporal para suspender la designación. El alivio, espera Anthropic, ayudaría a convencer a algunos de los miembros de la empresa. clientes asustadizos quedarme con esto un poco más. Lin sólo podrá tomarse un descanso si determina que es probable que Anthropic gane el caso en general. Se espera su decisión sobre la medida cautelar en los próximos días.

La disputa ha provocado un debate público más amplio sobre cómo los militares utilizan cada vez más la inteligencia artificial y si las empresas de Silicon Valley deberían dar deferencia al gobierno a la hora de determinar cómo se implementa la tecnología que desarrollan.

El Departamento de Defensa, que ahora se llama Departamento de Guerra (DoW), argumentó que siguió los procedimientos y determinó apropiadamente que ya no se podía confiar en que las herramientas de inteligencia artificial de Anthropic funcionaran como se esperaba durante los momentos críticos. Le pidió a Lin que no dudara de su evaluación de la amenaza que, según él, representa Anthropic para la seguridad nacional.

“La preocupación es que Anthropic, en lugar de simplemente plantear preocupaciones y reaccionar, diga que tenemos un problema con lo que está haciendo el Departamento de Guerra y manipule el software… para que no funcione de la manera que el Departamento de Guerra espera y quiere”, dijo el abogado de la administración Trump, Eric Hamilton, durante la audiencia del martes.

Lin dijo que era papel del Secretario de Defensa, Pete Hegseth, no de ella, decidir si Anthropic es un proveedor adecuado para el departamento. Pero Lin dijo que depende de ella determinar si Hegseth violó la ley al tomar medidas más allá de simplemente cancelar los contratos gubernamentales de Anthropic. Lin dijo que le resultaba “preocupante” que la designación de seguridad y las directivas que limitan más ampliamente el uso de la herramienta de inteligencia artificial de Anthropic, Claude, por parte de contratistas gubernamentales “no parecen adaptarse a las preocupaciones de seguridad nacional declaradas”.

A medida que la lucha de Anthropic con el gobierno se intensificaba el mes pasado, Hegseth publicado en X que “con efecto inmediato, ningún contratista, proveedor o socio que haga negocios con las fuerzas armadas de los Estados Unidos podrá realizar actividad comercial alguna con Anrópica”.

Pero el martes, Hamilton reconoció que Hegseth no tiene la autoridad legal para impedir que los contratistas militares utilicen Anthropic para trabajos no relacionados con el Departamento de Defensa. Cuando Lin le preguntó por qué Hegseth habría publicado esto, Hamilton dijo: “No lo sé”.

Lin también preguntó a Hamilton si el Pentágono había considerado tomar medidas menos punitivas para que el departamento dejara de utilizar las herramientas de Anthropic. Describió la designación de riesgos en la cadena de suministro como una autoridad poderosa normalmente reservada para adversarios extranjeros, terroristas y otros actores hostiles.

Michael Mongan, un abogado de WilmerHale que representa a Anthropic, dijo que era extraordinario que el gobierno persiguiera a un socio negociador “obstinado” con la designación.

El Pentágono dijo que está trabajando para reemplazar las tecnologías antropogénicas en los próximos meses con alternativas de Google, OpenAI y xAI. También manifestó que implementó medidas para evitar que Anrópica se involucrara en cualquier manipulación durante la transición. Hamilton dijo que no sabía si Anthropic podía actualizar sus modelos de IA sin el permiso del Pentágono; la empresa dice que no.

Se espera una decisión pronto sin audiencia en el otro caso, en el tribunal federal de apelaciones en Washington, D.C.