he estado probando La nueva automatización de tareas de Gemini en Pixel 10 Pro y Galaxy S26 Ultra, que por primera vez permite a Gemini tomar el volante y usar aplicaciones por ti. En este momento, está limitado a un pequeño subconjunto (algunos servicios de entrega de alimentos y transporte privado) y todavía está en versión beta. Es lento, a veces complicado y no resuelve ningún problema grave que haya tenido al usar su teléfono. Pero es increíblemente impresionante, y no creo que sea exagerado decir que esto es un vistazo al futuro. Todavía estamos muy lejos, pero esta es la primera vez que veo a un verdadero asistente de IA trabajando en un teléfono, no en una presentación principal o una demostración cuidadosamente controlada dentro de una sala de convenciones.

En primer lugar: Géminis es mucho más lento que tú, que yo o que la mayoría de las personas a la hora de usar su teléfono. Si necesitas pedir un Uber este segundoSigues siendo la mejor persona para el trabajo. Antes de rendirte, recuerda que la automatización de tareas está diseñada para ejecutarse en segundo plano mientras haces otras cosas en tu teléfono. Aún mejor, sigue funcionando mientras estás No mirando su teléfono para poder hacer cosas como verificar si su pasaporte está en su bolso por décima vez.

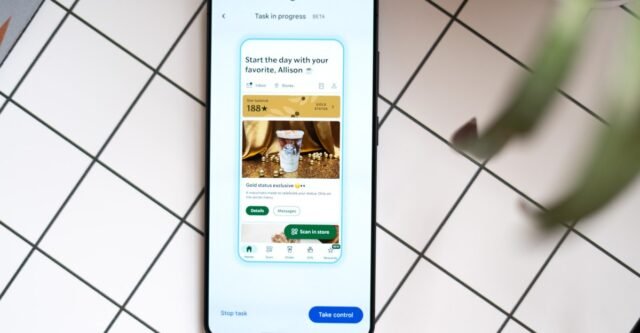

Pero si tienes curiosidad, como yo, puedes ver cómo sucede todo. Mientras funciona, aparece un texto en la parte inferior de la pantalla que indica lo que está haciendo Gemini. Cosas como “Selecciona una segunda porción de pollo teriyaki para el combo”, que sucedieron cuando pedí mi cena el sábado por la noche. Ver a Géminis resolver las cosas sobre la marcha honestamente es una especie de reglas. Pedí un plato combinado de pollo; el menú presentaba opciones en incrementos de media ración, por lo que añadió correctamente dos medias raciones de pollo.

Es mejor si cuando inicias una automatización con Gemini, el comportamiento predeterminado es que se ejecute en segundo plano. Debes tocar un botón y abrir otra ventana si quieres ver a Gemini trabajar en la tarea. Y puede resultar insoportable. Ver tu computadora tratando de encontrar una guarnición de verduras en un menú de Uber Eats cuando es sentado allí en la parte superior de la pantalla Es como ver una película de terror y saber que el asesino está en el armario junto al protagonista. Quiero decir, excepto por la parte del asesinato. Gemini cometió algunos errores al preparar mi pedido de teriyaki, que terminó resolviendo por su cuenta, pero el episodio completo duró unos nueve minutos. No es ideal.

Se supone que Géminis realizará su tarea hasta que llegue el momento de confirmar y ordenar tu auto o cena para que puedas verificar su funcionamiento. Creo que esta es la única forma sensata de utilizar esta función en este momento y no me importa la fricción adicional que supone completar el pedido. En las pruebas que realicé durante los últimos cinco días, nunca tuve ningún problema y terminé mi pedido por mí mismo. Y es sorprendentemente preciso; Tuve que hacer algunos ajustes al orden final. Si falla, lo que he visto suceder varias veces, tiende a suceder en el primer minuto o dos, cuando algo en la aplicación necesita mi atención, como dar permiso para usar mi ubicación o cambiar la ubicación de entrega a casa en lugar de Nevada, que fue el último lugar donde usé esta aplicación. Tuve que averiguar cuál era el problema en casos como este, pero una vez resuelto pude reiniciar la automatización sin ningún problema.

Esto es lo que realmente me atrapó. Puse un evento en mi calendario para un vuelo a San Francisco al día siguiente (un viaje falso para mí, pero detalles reales del vuelo). Le di a Gemini un aviso vago para que programara un Uber que me llevaría al aeropuerto a tiempo para mi vuelo de mañana. Dado que Gemini tiene acceso a mi correo electrónico y calendario, puede encontrar esta información. Se requirió orientación adicional, posiblemente porque el vuelo no estaba en mi correo electrónico como se esperaba. Pero con eso, encontró la información del vuelo, me sugirió salir alrededor de las 11:30 o 11:45 (hora lógica para un vuelo de las 13:45, ya que vivo cerca del aeropuerto) y me preguntó si quería programar un viaje para uno de esos horarios. Confirmé la hora y comencé a preparar el viaje en unos tres minutos, sin necesidad de más información de mi parte.

Es un poco más impresionante si se tiene en cuenta que Uber ni siquiera se refiere a él como programación un paseo – usted reserva un paseo. Ésta es la principal diferencia entre los asistentes digitales que utilizamos y los asistentes de IA que están surgiendo ahora. Ser capaz de utilizar lenguaje natural al hablar con la computadora. Hace una gran diferencia cuando controlas tu hogar inteligente o haciendo su pedido de cena. Si la computadora va a tropezar y pedir una aclaración cuando usted olvida que el restaurante llama a su comida un “plato” y no un “combo”, o si pide “ensalada” en lugar de “repollo rallado”, entonces no es más útil que los asistentes que hemos utilizado durante la última década para configurar temporizadores y reproducir música.

Dicho esto, ver a Gemini tocar y desplazarse por Uber Eats deja una cosa dolorosamente obvia: si estuvieras diseñando una aplicación para usar IA, no se parecería en nada a las que tenemos hoy. Ya sabes, aplicaciones diseñadas para humanos. Un asistente de IA no se dejará tentar por un gran anuncio en medio de una página para ahorrar un 30% en su pedido. Una foto apetitosa y bien preparada del plato pedido no convence más que una de baja calidad. Le darías una base de datos, no un montón de cosas que limpiar. algo en lo que la industria está trabajando en el Protocolo de contexto modelo, o MCP.

Un modelo de IA que razona a través de una interfaz centrada en el ser humano parece la forma más impráctica y frágil de realizar un pedido de pizza. De vez en cuando se topa con un obstáculo y no es bueno para decírtelo. por qué no pude hacer nada. Esta versión de automatización de tareas parece un recurso provisional hasta que los desarrolladores de aplicaciones adopten métodos más sólidos: MCP o Funciones de la aplicación Android. El jefe de Android de Google, Sameer Samat me dijo recientemente que Géminis adopta el enfoque de razonamiento en ausencia de los otros dos. Quizás esta versión de la automatización de tareas sea nuestra vista previa de lo que es posible o una forma de alentar a los desarrolladores a adoptar uno de los otros métodos. De cualquier manera, esto parece un primer paso notable hacia una nueva forma de utilizar nuestros asistentes móviles: extraña, lenta, pero muy prometedora.

Fotografía de Allison Johnson/The Verge