Las inundaciones repentinas se encuentran entre los fenómenos meteorológicos más mortíferos del mundo y matan a más de 5.000 personas cada año. También se encuentran entre los más difíciles de predecir. Pero Google cree que ha resuelto este problema de una manera poco probable: leyendo las noticias.

Aunque los humanos han recopilado una gran cantidad de datos meteorológicos, las inundaciones repentinas son demasiado breves y localizadas para medirse de manera integral, de la misma manera que la temperatura o incluso el caudal de los ríos se monitorean a lo largo del tiempo. Esta brecha de datos significa que los modelos de aprendizaje profundo, que son cada vez más capaces de predecir el clima, no pueden predecir inundaciones repentinas.

Para resolver este problema, los investigadores de Google utilizaron Gemini (el modelo de lenguaje masivo de Google) para clasificar 5 millones de artículos de noticias de todo el mundo, aislando informes de 2,6 millones de inundaciones diferentes y convirtiéndolos en una serie de tiempo geoetiquetada apodado “Groundsource”. Esta es la primera vez que la empresa utiliza modelos de lenguaje para este tipo de trabajo, según Gila Loike, gerente de producto de Google Research. La investigación y el conjunto de datos fueron compartido públicamente Jueves por la mañana.

Con Groundsource como base del mundo real, los investigadores entrenó un modelo construido sobre una red neuronal de memoria a largo plazo (LSTM) para ingerir pronósticos meteorológicos globales y generar la probabilidad de inundaciones repentinas en un área determinada.

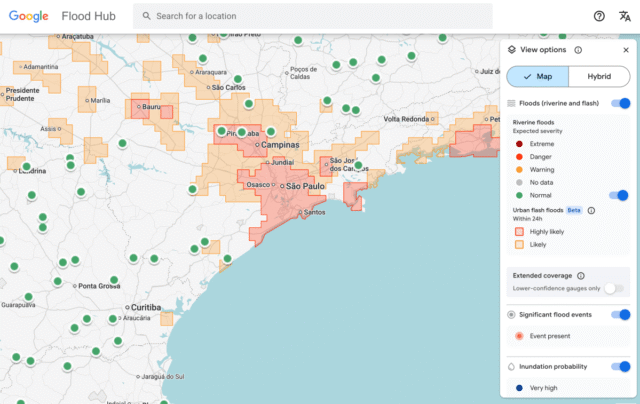

El modelo de predicción de inundaciones repentinas de Google ahora destaca los riesgos para las áreas urbanas en 150 países en el sitio web de la compañía. Centro de inundaciones plataforma y compartir sus datos con agencias de respuesta a emergencias de todo el mundo. António José Beleza, oficial de respuesta a emergencias de la Comunidad de Desarrollo de África Austral que probó el modelo de predicción con Google, dijo que ayudó a su organización a responder a las inundaciones más rápidamente.

Todavía existen limitaciones para el modelo. Por un lado, tiene una resolución muy baja, identificando riesgos en áreas de 20 kilómetros cuadrados. Y no es tan preciso como el sistema de alerta de inundaciones del Servicio Meteorológico Nacional, en parte porque el modelo de Google no incorpora datos de radar locales, lo que le permite rastrear las precipitaciones en tiempo real.

Parte del problema, sin embargo, es que el proyecto está diseñado para funcionar en lugares donde los gobiernos locales no pueden permitirse invertir en costosas infraestructuras de detección del clima o no tienen registros extensos de datos meteorológicos.

Evento tecnológico

San Francisco, California

|

13-15 de octubre de 2026

“Debido a que estamos agregando millones de informes, el conjunto de datos de Groundsource realmente ayuda a reequilibrar el mapa”, dijo a los periodistas esta semana Juliet Rothenberg, directora de programas del equipo de Resiliencia de Google. “Esto nos permite extrapolar a otras regiones donde no hay tanta información”.

Rothenberg dijo que el equipo espera que el uso de LLM para desarrollar conjuntos de datos cuantitativos a partir de fuentes cualitativas escritas pueda aplicarse a los esfuerzos para construir conjuntos de datos sobre otros fenómenos efímeros pero importantes para el pronóstico, como olas de calor y deslizamientos de tierra.

Marshall Moutenot, director ejecutivo de Upstream Tech, una empresa que utiliza modelos de aprendizaje profundo similares para predecir los caudales de los ríos para clientes como empresas hidroeléctricas, dijo que la contribución de Google es parte de un esfuerzo creciente para recopilar datos para modelos de pronóstico del tiempo basados en el aprendizaje profundo. Moutenot cofundó dinámica.orgun grupo que selecciona una colección de datos meteorológicos listos para el aprendizaje automático para investigadores y nuevas empresas.

“La escasez de datos es uno de los desafíos más difíciles de la geofísica”, dijo Moutenot. “Al mismo tiempo, hay demasiados datos de la Tierra y, cuando se quiere comparar con la verdad, no hay suficientes datos. Este fue un enfoque realmente creativo para obtener esos datos”.