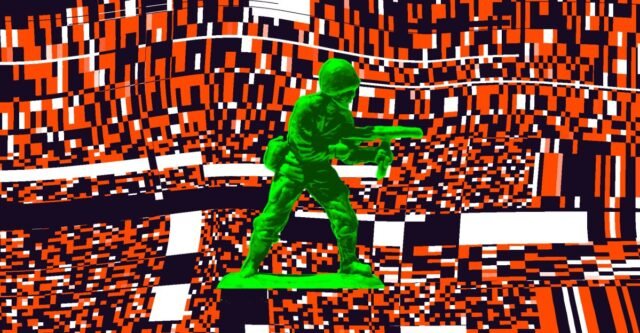

Los métodos de Meta para identificar deepfakes “no son lo suficientemente sólidos ni completos” para hacer frente a la rapidez con la que se propaga la información errónea durante conflictos armados como la guerra en Irán. Esto es según la Junta de Supervisión de Meta, un organismo semiindependiente que guía las prácticas de moderación de contenido de la empresa, que ahora pide a Meta que revise su forma de funcionar. superficies y etiquetas Contenido generado por IA en Facebook, Instagram y Threads.

El llamado a la acción se produce una investigación sobre un vídeo falso de IA de presuntos daños a edificios en Israel que se compartió en las plataformas sociales de Meta el año pasado, pero el Consejo dice que sus recomendaciones son particularmente relevantes en este momento, dadas las “escaladas militares masivas” en todo el Medio Oriente esta semana. En su anuncio, el Consejo afirma que el acceso a información precisa y fiable es vital para la seguridad de las personas en medio del mayor riesgo de que se utilicen herramientas de inteligencia artificial para difundir desinformación.

“Los hallazgos de la Junta resaltan que el sistema actual de Meta para etiquetar adecuadamente el contenido de IA depende demasiado de la autodivulgación del uso de la IA y la revisión por niveles y no cumple con las realidades del entorno en línea actual”, dijo la Junta de Supervisión de Meta. “El caso también resalta los desafíos de la proliferación multiplataforma de este tipo de contenido, ya que el contenido parece haberse originado en TikTok antes de aparecer en Facebook, Instagram y X”.

Las medidas recomendadas emitidas por el Consejo incluyen presionar a Meta para que mejore sus reglas existentes sobre desinformación para abordar los deepfakes engañosos y establecer un nuevo estándar comunitario separado para el contenido generado por IA. También se le pide a Meta que desarrolle mejores herramientas de detección de IA, que sea transparente sobre las sanciones por violaciones de las políticas de IA y que amplíe los esfuerzos de etiquetado de contenido de IA. Esto último incluye garantizar que se agreguen etiquetas de “IA de alto riesgo” a las imágenes y videos sintéticos con mayor frecuencia y mejorar la adopción de C2PA (también conocido como Credenciales de contenido) para que la información sobre el contenido generado por IA sea “claramente visible y accesible para los usuarios”.