Durante el fin de semana, Andrej Karpathy, el influyente ex líder y cofundador de Tesla AI y ex miembro de OpenAI que acuñó el término “vibe coding”, publicado en X sobre su nuevo proyecto de código abierto, búsqueda automática.

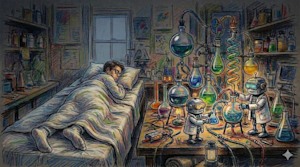

No era un modelo terminado ni un producto corporativo masivo: era, según admitió él mismo, un simple guión de 630 líneas. disponible en Github bajo una licencia MIT permisiva y amigable para las empresas. Pero la ambición era enorme: automatizar el método científico con agentes de IA mientras los humanos dormimos.

“El objetivo es diseñar a sus agentes para que hagan el progreso más rápido en la investigación de forma indefinida y sin su participación”, afirmó en X.

El sistema funciona como un ciclo de optimización autónomo. Un agente de IA recibe un guión de entrenamiento y un presupuesto informático fijo (normalmente 5 minutos en una GPU).

Lee su propio código fuente, formula una hipótesis de mejora (como cambiar la tasa de aprendizaje o la profundidad de la arquitectura), modifica el código, ejecuta el experimento y evalúa los resultados.

Si hay pérdida de validación, medida en bits por byte (val_bpb)—mejora, mantiene el cambio; de lo contrario, retrocede y vuelve a intentarlo. En En una sola noche, el agente de Karpathy completó 126 experimentos.reduciendo la pérdida de 0,9979 a 0,9697.

Hoy, Karpathy informó que después de dejar que el agente modificara un modelo de “profundidad = 12” durante dos días, pudo procesó aproximadamente 700 cambios autónomos.

El agente encontró alrededor de 20 mejoras aditivas que se transfirieron sin problemas a modelos más grandes. La acumulación de estos cambios redujo la métrica “Tiempo para GPT-2” en la tabla de clasificación de 2,02 horas a 1,80 horas, una ganancia de eficiencia del 11 % en un proyecto que Karpathy creía que ya estaba bien ajustado.

“Ver al agente hacer todo este flujo de trabajo de extremo a extremo por sí solo… es una locura”, señaló Karpathy, señalando que el agente detectó descuidos en la ampliación y regularización de la atención que había perdido manualmente durante dos décadas de trabajo.

Esto es más que un simple truco de productividad; es un cambio fundamental en la forma en que se refina la inteligencia. Al automatizar el “método científico” del código, Karpathy transformó el aprendizaje automático en un proceso evolutivo que funciona a la velocidad del silicio en lugar de a la velocidad del pensamiento humano.

Y más que eso, mostró a la comunidad más amplia de inteligencia artificial y aprendizaje automático en X que este tipo de proceso podría aplicarse mucho más allá de la informática, en áreas como marketing, atención médica y, bueno, básicamente cualquier cosa que requiera investigación.

La autoinvestigación se extiende por todas partes

La reacción fue rápida y viral, y la publicación de Karpathy obtuvo más de 8,6 millones de visitas durante los dos días siguientes, mientras constructores e investigadores se apresuraban a escalar el “ciclo de Karpathy”.

Varun Mathur, director ejecutivo de la plataforma de agregación de herramientas de inteligencia artificial Hyperspace AI, tomó el bucle de agente único y lo distribuyó a través de una red de igual a igual. Cada nodo que ejecutaba el agente Hyperspace se convirtió en un investigador autónomo.

En la noche del 8 al 9 de marzo, 35 agentes autónomos de la red Hiperespacial llevaron a cabo 333 experimentos completamente sin supervisión. Los resultados fueron una clase magistral en estrategia emergente:

La diversidad de hardware como recurso: Mathur señaló que, si bien las GPU H100 utilizaban “fuerza bruta” para encontrar tasas de aprendizaje agresivas, los agentes exclusivos de CPU en las computadoras portátiles se veían obligados a ser inteligentes. Estos actores “desvalidos” se centraron en estrategias de inicialización (como Kaiming y Xavier init) y opciones de normalización porque no podían confiar en el rendimiento bruto.

Descubrimiento basado en chismes: Utilizando el protocolo GossipSub, los agentes compartieron sus ganancias en tiempo real. Cuando un agente descubrió que la startup Kaiming reducía las pérdidas en un 21%, la idea se extendió por la red como un virus digital. En cuestión de horas, otros 23 agentes incorporaron el descubrimiento a sus propias hipótesis.

La compresión de la historia.: En solo 17 horas, estos agentes redescubrieron de forma independiente hitos de ML como RMSNorm y vincularon incorporaciones que tardaron casi ocho años en ser formalizadas por investigadores humanos en laboratorios como Google Brain y OpenAI.

Realice 36.500 experimentos de marketing al año en lugar de 30

Mientras los puristas del ML se centraban en las curvas de pérdidas, el mundo empresarial vio un tipo diferente de revolución. Eric Siu, fundador de la agencia de publicidad Single GrainAutoinvestigación aplicada al “Circuito Experimental” del marketing.

“La mayoría de los equipos de marketing realizan alrededor de 30 experimentos al año”, escribió Siu en X. “La próxima generación realizará más de 36.500. Y continuó:

“Harán experimentos mientras duermen. Los equipos de marketing de hoy realizan de 20 a 30 experimentos al año. Quizás 52 si son ‘buenos’. Nueva página de destino. Nueva creatividad publicitaria. Tal vez una prueba de línea de asunto. Esto se considera “marketing basado en datos”. Pero la próxima generación de sistemas de marketing ejecutará más de 36.500 experimentos al año”.

El marco de Siu reemplaza el guión de capacitación con un activo de marketing: una página de destino, creatividad publicitaria o un correo electrónico frío. El agente modifica una variable (la línea de asunto o CTA), la implementa, mide la “tasa de respuesta positiva” y la conserva o la descarta.

Siu sostiene que esto crea un “mapa propietario” de lo que resuena en una audiencia específica: un foso construido no a partir de código sino de la historia de experimentos. “Las empresas ganadoras no tendrán mejores especialistas en marketing”, escribió, “tendrán ciclos de experimentación más rápidos”.

Discusión comunitaria y ‘joder’ el conjunto de validación

A pesar del fervor, el Discusiones de GitHub reveló una comunidad que lucha con las implicaciones de un progreso tan rápido y automatizado.

La trampa de la sobreoptimización: Investigador alexistual planteó una preocupación conmovedora: “¿No le preocupa que el lanzamiento de tantos experimentos termine ‘estropeando’ el conjunto de validación?” El temor es que con suficientes agentes, los parámetros se optimicen para las peculiaridades específicas de los datos de prueba en lugar de la inteligencia general.

El significado de las ganancias.: Usuario Samionb cuestionó si una caída de 0,9979 a 0,9697 era realmente notable. La respuesta de Karpathy fue característicamente contundente: “Todo lo que estamos haciendo es optimizar el rendimiento por cómputo… estas son ganancias reales y sustanciales”.

El elemento humano: Sin X, usuario magoJefe de Crecimiento de la plataforma criptográfica Finanzas Yaridocumentó su propia ejecución nocturna en una Mac Mini M4, señalando que si bien 26 de 35 experimentos fallaron o fallaron, los siete que tuvieron éxito revelaron que “el modelo mejoró al volverse más simple”.

Esta comprensión (de que a menudo menos es más) se logró sin una sola intervención humana.

El futuro: la curiosidad como cuello de botella

El lanzamiento de la búsqueda automática sugiere un futuro de investigación en ámbitos en los que, gracias a simples mecanismos de instrucción de la IA, el papel del ser humano cambia de “experimentador” a “diseñador experimental”.

A medida que surgen herramientas como DarkMatter, Optimization Arena y NanoClaw para respaldar este enjambre, el cuello de botella del progreso de la IA ya no es la capacidad de codificación de la “computadora de carne” (la descripción de Karpathy del cerebro humano), sino nuestra capacidad de definir las limitaciones de la búsqueda.

Andrej Karpathy volvió a cambiar el humor. Ya no nos limitamos a codificar modelos; estamos sembrando ecosistemas que aprenden mientras dormimos.