Emmanuel Macron respondió a las críticas de Estados Unidos a los esfuerzos de Europa para regular la IA prometiendo proteger a los niños del “abuso digital” durante la presidencia francesa del G7.

En su intervención en la cumbre AI Impact en Delhi, el presidente francés pidió salvaguardias más estrictas tras la indignación global por el uso del chatbot Grok de Elon Musk para generar decenas de miles de imágenes sexualizadas de niños, y en medio de crecientes preocupaciones sobre la concentración del poder de la IA en un puñado de empresas.

António Guterres, el secretario general de la ONU, se hizo eco de sus comentarios y dijo a los delegados (incluidos varios multimillonarios tecnológicos estadounidenses) que “ningún niño debería ser un conejillo de indias para la IA no regulada”.

“El futuro de la IA no lo pueden decidir unos pocos países ni dejarlo al capricho de unos pocos multimillonarios”, afirmó Guterres. “La IA debería pertenecer a todos”.

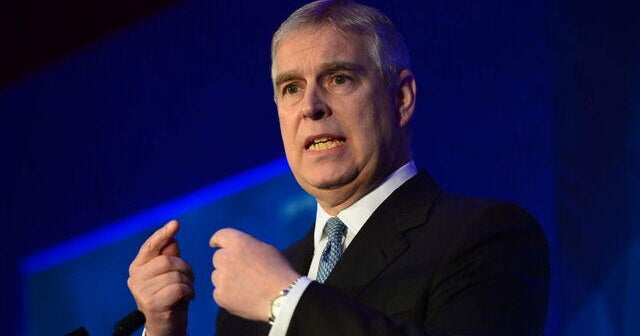

Estaba previsto que Bill Gates hablara, pero se rindió en el último minuto en medio de un renovado escrutinio de sus vínculos pasados con el delincuente sexual infantil convicto Jeffrey Epstein.

Mientras tanto, un intento del primer ministro indio, Narendra Modi, de organizar una muestra de unidad entre los principales multimillonarios de la tecnología salió mal cuando los jefes rivales de OpenAI y Anthropic se negaron torpemente a unir sus manos en el escenario.

Modi estaba en el centro de una fila de 13 ejecutivos de tecnología, incluidos líderes de Google, Meta y Microsoft, que levantaron las manos juntas, excepto Sam Altman y Dario Amodei. Amodei se separó de OpenAI en 2021 debido a diferencias sobre cómo gestionar los riesgos de seguridad.

El miércoles, el asesor principal de IA de la Casa Blanca, Sriram Krishnan, renovó las críticas de la administración Trump a la regulación de la IA, destacando la Ley de IA de la UE. Dijo a los delegados que continuaría “argumentando” en contra de una legislación que no fuera “propicia para un empresario que quiera desarrollar tecnología innovadora”.

Pero Macron dijo en la cumbre intergubernamental: “Al contrario de lo que han dicho algunos amigos mal informados, Europa no se centra ciegamente en la regulación. Europa es un espacio para la innovación y la inversión, pero es un espacio seguro, y los espacios seguros ganan a largo plazo”.

Investigación publicada este mes Un estudio realizado por Unicef e Interpol en 11 países encontró que al menos 1,2 millones de niños informaron que sus imágenes fueron manipuladas para crear deepfakes sexualmente explícitos el año pasado. En algunos países, uno de cada 25 niños (el equivalente a un niño por aula) se ha visto afectado.

“No hay ninguna razón para que nuestros niños estén expuestos en línea a lo que está legalmente prohibido en el mundo real”, afirmó Macron. “Nuestras plataformas, gobiernos y reguladores deberían trabajar juntos para hacer de Internet y las redes sociales un espacio seguro. Por eso, en Francia, nos estamos embarcando en un proceso para prohibir las redes sociales para niños menores de 15 años”.

Entre los ejecutivos de tecnología presentes se encontraba Sam Altman, director ejecutivo de OpenAI, quien enfrenta una demanda de la familia de Adam Raine, un joven de 16 años que se quitó la vida. después de hablar sobre el suicidio con ChatGPT.

Altman dijo a los delegados que el rápido ritmo de desarrollo de la IA significaba que “para fines de 2028, una mayor capacidad intelectual del mundo podría residir dentro de los centros de datos que fuera de ellos”. También enfatizó la necesidad urgente de “regulaciones o salvaguardias” y pidió la creación de un organismo similar a la Agencia Internacional de Energía Atómica para supervisar la coordinación internacional de la IA.

Dario Amodei, codirector ejecutivo de Anthropic, dijo que estaba “preocupado por el comportamiento autónomo de los modelos de IA, su potencial de uso indebido por parte de individuos y gobiernos, y su potencial de desplazamiento económico”.

Modi dijo que era “imperativo que la IA sea segura para los niños y esté orientada a las familias”, comparando el surgimiento de la IA con el descubrimiento del fuego y calificándolo de “profunda transformación en la historia de la humanidad”.

India busca posicionarse como la tercera potencia mundial en inteligencia artificial detrás de Estados Unidos y China, y Google anunció esta semana una inversión de 15 mil millones de dólares en centros de datos y cables submarinos que conectan a India con Estados Unidos y otros países.

Modi dijo que debe haber “niveles establecidos de autenticidad para el contenido en el mundo digital… la gente debe saber qué es auténtico y qué genera la IA”.

Las intervenciones se producen en un contexto de creciente preocupación pública por los riesgos sociales de la IA, ya que los modelos más avanzados siguen estando controlados en gran medida por unas cuatro empresas norteamericanas y un puñado de rivales chinos.

Modi presentó una visión alternativa, aprovechando la población de 1.400 millones de personas de la India como un enorme mercado de crecimiento para las empresas de tecnología. Dijo: “Debemos evitar un monopolio de la IA. Muchas naciones consideran que la IA es un activo estratégico y, por lo tanto, se desarrolla de forma confidencial y su disponibilidad se gestiona cuidadosamente.

“Sin embargo, nuestra nación, India, tiene una perspectiva diferente. Creemos que la tecnología, en sí misma, sólo beneficiará verdaderamente al mundo cuando se comparta y cuando el código fuente abierto esté disponible”.

Sus comentarios parecían estar dirigidos a Estados Unidos, donde los principales modelos de IA no son de código abierto y no pueden usarse ni adaptarse sin permiso. Por otro lado, los sistemas líderes de China, como DeepSeek y Qwen, son en gran medida de código abierto.