Para muchos indios, la ansiedad por la salud no comienza en la clínica. Empiece más tarde. Llega un informe de análisis de sangre a WhatsApp. Ciertos valores están resaltados en negrita. Los números están fuera de los rangos de referencia. Los términos médicos no le resultan familiares y, cuando se programa una cita de seguimiento, el paciente ya ha consultado motores de búsqueda, familiares y referencias en las redes sociales.

Esta brecha entre recibir datos de salud y comprenderlos se ha ampliado en los últimos años. Las pruebas preventivas han aumentado, los dispositivos portátiles como el Apple Watch o las aplicaciones de fitness monitorean las métricas diarias, mientras que las enfermedades crónicas como la diabetes y los trastornos de la tiroides requieren un control constante mediante intervenciones de glucosa en sangre. Sin embargo, al mismo tiempo, el tiempo de consulta sigue siendo limitado y la interpretación a menudo se deja en manos de los pacientes.

Es en este espacio donde se están posicionando los asistentes de atención médica basados en IA, como el recientemente anunciado ChatGPT Health de OpenAI. No como herramientas de diagnóstico o sustitutos de los médicos, sino como ayudas que ayudan a las personas a comprender la información médica que ya tienen.

Cuando la información genera ansiedad

Según el Dr. Akshat Chadha, médico general de Mumbai especializado en medicina del estilo de vida, la mala comprensión de los informes médicos es rutinaria y no excepcional. “La notificación es complicada y las cifras en negrita lo hacen aún más difícil. La mayoría de los pacientes asumen lo peor con cada número anormal”, dice.

A menudo también se malinterpretan las recetas. “Las instrucciones de los medicamentos se vuelven confusas cuando una receta incluye varios medicamentos. Entre las personas mayores, los medicamentos a menudo se identifican por el color y la forma en lugar de por el nombre”.

Esta confusión no es anecdótica. Un estudio transversal de 2024 titulado Uso de Internet para información de salud y conductas de búsqueda de salud entre adultos por Bhangare, Ashturkar y Giri, publicado en Revista Internacional de Medicina Comunitaria y Salud Públicaencontró que el 82% de 400 adultos en el oeste de Maharashtra usaban Internet para buscar información de salud. Casi la mitad investigó detalles relacionados con el medicamento, como dosis y efectos secundarios, mientras que el 45% buscó síntomas y diagnóstico de la enfermedad.

Buscar primero, hacer preguntas después

El impulso de buscar en lugar de preguntar es en parte conductual y en parte estructural. Una encuesta transversal de médicos indios realizada en 2024 titulada “Prácticas de comunicación médico-paciente: una encuesta transversal de médicos indios”, en la que participaron 500 médicos de facultades de medicina gubernamentales y privadas, informó un tiempo promedio de consulta de 9,8 minutos y encontró que solo una parte de los médicos animaban habitualmente a los pacientes a hablar en detalle sobre todos sus problemas de salud. En estos entornos, los pacientes pueden irse con instrucciones, pero sin la confianza ni la oportunidad de aclarar lo que podría significar un número, por qué se agregó un medicamento o qué patrones de síntomas deberían impulsar una nueva visita.

Esta realidad ayuda a explicar por qué el uso de Internet y la autointerpretación relacionados con la salud son ahora algo común y por qué la conversación sobre las herramientas de IA ha pasado del diagnóstico a la preparación.

Interpretación, no diagnóstico

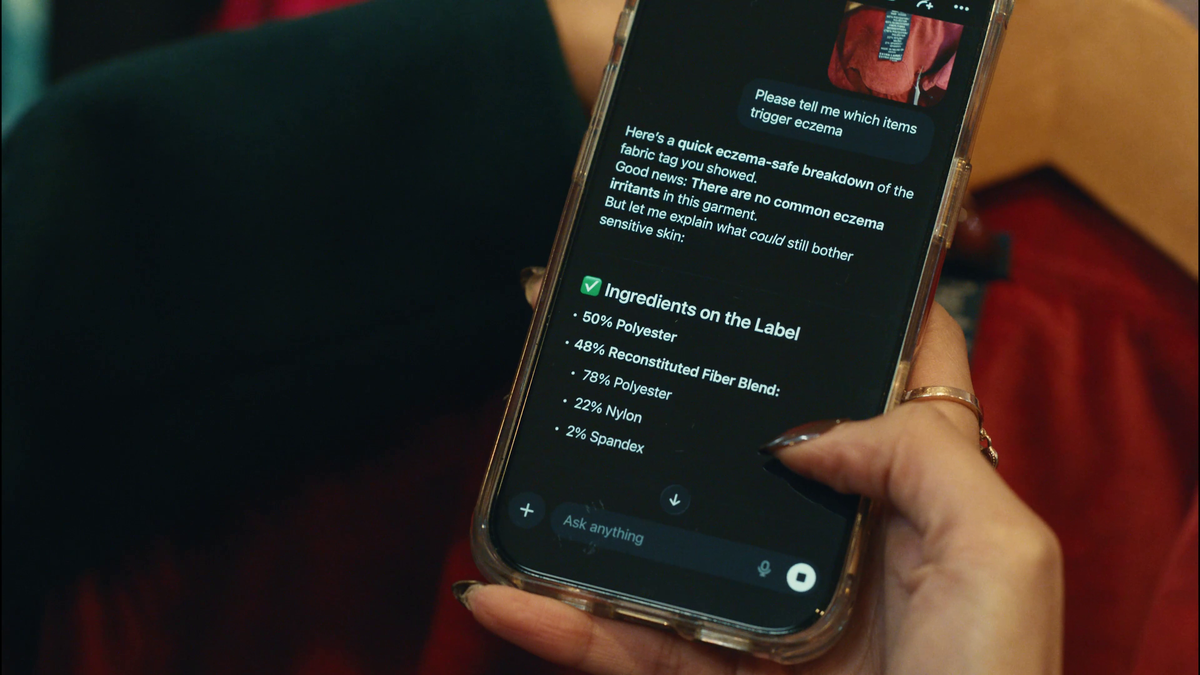

ChatGPT Health es una función especializada de ChatGPT que tiene como objetivo ayudar a los usuarios a comprender información relacionada con la salud, no a tomar decisiones clínicas. OpenAI enfatiza que está diseñado para ayudar en la interpretación de informes médicos, recetas y datos de bienestar (opcionalmente vinculados a la información de salud y estado físico del usuario) en lugar de ofrecer diagnósticos o consejos de tratamiento.

Dentro de estos límites, ChatGPT Health explica los valores de laboratorio en un lenguaje sencillo, ayuda a los usuarios a identificar patrones en los datos de estilo de vida, como el sueño, la actividad y la nutrición, y ayuda a los pacientes a hacer preguntas más claras antes o después de la cita con el médico. La intención es complementar la atención clínica, mejorando la comprensión y la preparación, y no sustituir el criterio médico.

El Dr. Akshat Chadha cree que esta distinción es fundamental. “Existe mucha información, alguna correcta, otra incorrecta y otra exagerada. Pero incluso la información correcta puede no ser relevante para un paciente específico”, afirma. “La gente termina leyendo cosas que no necesita, lo que crea más problemas que soluciones”.

Él ve valor en las herramientas de inteligencia artificial que simplifican la información relevante para los usuarios individuales y la presentan de manera simple, pero establecen límites firmes. “Estas herramientas deben no llegar al diagnóstico, ni siquiera al diagnóstico diferencial, y evitar opciones de tratamiento o detalles de dosificación. De lo contrario, aumenta la automedicación”.

Esta preocupación se refleja en las investigaciones existentes. Una revisión sistemática y un metanálisis titulado Prevalencia y predictores de las prácticas de automedicación en la India: una revisión sistemática de la literatura y un metanálisisque examinó 17 estudios con 10.248 participantes, encontró una prevalencia agrupada de automedicación del 53,57% en las poblaciones indias. Si bien la cifra merece una interpretación cautelosa, su escala subraya por qué los médicos advierten constantemente contra el desvío de herramientas digitales y basadas en inteligencia artificial para asesorar sobre tratamientos.

Condiciones sensibles y atención tardía.

En especialidades como la urología los retrasos en las consultas ya son habituales. El Dr. Satyajeet P. Pattnaik, urólogo y cirujano de trasplantes, dice que las dudas a menudo están impulsadas por el miedo, el estigma y los consejos informales. “Los pacientes retrasan la búsqueda de un médico por falta de comprensión, miedo u orientación de fuentes no médicas. Muchos acaban automedicándose”, afirma.

Ve un valor potencial en las herramientas de inteligencia artificial que ayudan a los pacientes a organizar los síntomas antes de una visita a la clínica. “Estamos entrando en una era de medicina preventiva. Si los pacientes pueden articular los síntomas de manera más lógica, permitirá una detección más temprana”.

Pero advierte contra el exceso de confianza. “El diagnóstico incorrecto y la automedicación inadecuada con productos de venta libre pueden retrasar el tratamiento adecuado”.

Fiebre, miedo y el problema de la autointerpretación

La ansiedad que rodea a los informes de laboratorio no se limita a las enfermedades crónicas. En India, a menudo alcanza su punto máximo durante los brotes estacionales, cuando las familias intentan interpretar los síntomas por sí mismas y retrasan la atención médica.

El Dr. V. Ramasubramanian, especialista en enfermedades infecciosas de los hospitales Apollo de Chennai, dice que la mala interpretación temprana se vuelve especialmente peligrosa en entornos de brotes. “Durante los brotes, incluso los pequeños retrasos pueden provocar complicaciones”, afirma. “La IA puede ayudar a los pacientes a decidir cuándo es necesario intensificar la escalada, pero sólo puede ofrecer opiniones y no conclusiones. La validación clínica es esencial”.

Donde es más cauteloso es en el mal uso de los antibióticos. “Muchos pacientes todavía ven los antibióticos como una panacea, incluso para las infecciones virales”, dice, y agrega que las decisiones en el mundo real están determinadas por las creencias culturales, la epidemiología local y la calidad de los aportes. “Esto hace que la orientación de la IA sin supervisión sea particularmente riesgosa”.

Sugiere que si se utiliza con cuidado, la IA funciona mejor como herramienta preparatoria (ayudar a los pacientes a comprender las pruebas y organizar las preguntas) que como sustituto del criterio médico.

Una lente de hospital público

Desde una perspectiva de salud pública, la escala y el acceso siguen siendo desafíos centrales. En los distritos urbanos, las vías de derivación no estructuradas a menudo empujan a los pacientes a hospitales terciarios incluso cuando las condiciones podrían tratarse en niveles inferiores, lo que genera congestión y retrasos en la atención.

El Dr. Ranjit Mankeshwar, decano asociado del Grupo de Hospitales Sir JJ en Mumbai, ve posibilidades de que las herramientas de interpretación basadas en inteligencia artificial mejoren la comprensión del paciente sin agregar presión a un sistema que ya está sobrecargado. “Especialmente para entender los medicamentos, las investigaciones de laboratorio, el seguimiento y las opciones de tratamiento”, afirma.

Sostiene que las preocupaciones sobre la alfabetización digital pueden ser exageradas. “La mayoría de los pacientes ahora tienen acceso a teléfonos móviles. Si las explicaciones son simples y lingüísticamente localizadas, la comprensión no debería ser una barrera”. Sin embargo, subraya la necesidad de poner límites: “Hay que restringir el acceso a los datos de medicación a nivel médico para evitar la automedicación”.

El riesgo de la desinformación

El Dr. Sunil Mehta, un anestesista con experiencia en hospitales gubernamentales y caritativos, está de acuerdo en que las herramientas de inteligencia artificial pueden mejorar la alfabetización sanitaria, pero advierte sobre consecuencias no deseadas. “La IA tiende a revelar el diagnóstico más raro posible, incluso cuando no se ajusta a la situación. Esto hace que los pacientes se sientan innecesariamente ansiosos”, afirma.

La preocupación refleja lo que los médicos ya ven en las búsquedas online. La diferencia, añade, dependerá de si los sistemas de IA priorizan la probabilidad, el contexto y la precaución sobre las posibilidades exhaustivas.

La alfabetización sanitaria como resultado real

Que herramientas como ChatGPT Health puedan tener un impacto positivo en la India dependerá no sólo de su sofisticación tecnológica sino también de su moderación. Establecer límites claros, localización, utilizar un lenguaje sencillo y alinearse con la ética médica decidirá si estas herramientas se convertirán en aliados confiables o si simplemente contribuirán a generar ruido innecesario.

![DOGE y XMR se detienen cuando la subasta de preventa de criptomonedas ZKP inicia un frenesí de compras 1000x [Next Crypto to Explode]](https://mascipolletti.com.ar/wp-content/uploads/2026/02/DOGE-XMR-Stall-While-ZKP-Cryptos-Presale-Auction-Ignites-a-1000x-Buying-Frenzy-Next-Crypto-to-Explod-238x178.jpeg)

![DOGE y XMR se detienen cuando la subasta de preventa de criptomonedas ZKP inicia un frenesí de compras 1000x [Next Crypto to Explode]](https://mascipolletti.com.ar/wp-content/uploads/2026/02/DOGE-XMR-Stall-While-ZKP-Cryptos-Presale-Auction-Ignites-a-1000x-Buying-Frenzy-Next-Crypto-to-Explod-100x75.jpeg)