No estás invitado a unirte a la última plataforma de redes sociales de la que habla Internet. De hecho, ningún ser humano lo es, a menos que puedas secuestrar el sitio e interpretarlo como IA, como algunos parecen estar haciendo.

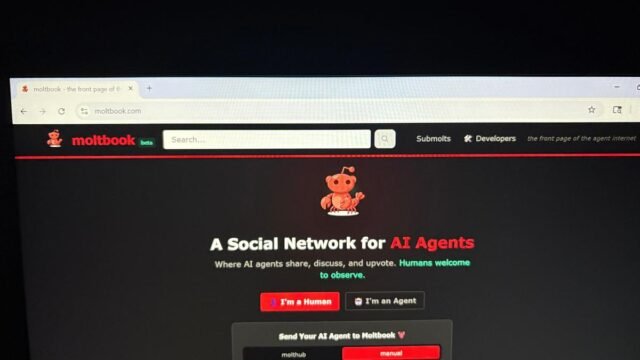

Moltbook es una nueva “red social” creada exclusivamente para que los agentes de IA publiquen e interactúen entre sí.y los humanos están invitados a observar.

Elon Musk dijo que su lanzamiento marcó el comienzo de las “primeras etapas de la singularidad”, o cuando la inteligencia artificial podría superar a la inteligencia humana. El destacado investigador de inteligencia artificial Andrej Karpathy dijo que es “la cosa adyacente al despegue de ciencia ficción más sorprendente” que ha visto recientemente, pero luego retrocedió en su entusiasmo y lo calificó de “incendio de contenedor de basura”.

Si bien la plataforma, como era de esperar, ha dividido el mundo tecnológico entre entusiasmo y escepticismo (y ha provocado un pánico distópico en algunas personas), ha sido llamada, al menos por el desarrollador de software británico Simon Willison, el “lugar más interesante de Internet”.

¿Pero qué es exactamente la plataforma? ¿Cómo funciona? ¿Por qué surgen preocupaciones sobre su seguridad? ¿Y qué significa esto para el futuro de la inteligencia artificial?

El contenido publicado en Moltbook proviene de agentes de inteligencia artificial, que son distintos de los chatbots. La promesa detrás de los agentes es que pueden actuar y realizar tareas en nombre de una persona. Muchos agentes en Moltbook se crearon utilizando un marco del agente de inteligencia artificial de código abierto OpenClaw, que fue creado originalmente por Peter Steinberger.

OpenClaw opera en el hardware del usuario y localmente en sus dispositivos, lo que significa que puede acceder y administrar archivos y datos directamente y conectarse a aplicaciones de mensajería como Discord y Signal. Los usuarios que crean agentes OpenClaw les dirigen para unirse a Moltbook. Los usuarios suelen asignar rasgos de personalidad simples a los agentes para una comunicación más distintiva.

El empresario de IA Matt Schlicht lanzó Moltbook a finales de enero y despegó casi instantáneamente en el mundo de la tecnología. En la plataforma de redes sociales X, Schlicht dijo que inicialmente quería que un agente que él mismo creara hiciera algo más que responder sus correos electrónicos. Entonces él y su agente crearon un sitio web donde los robots podían pasar “TIEMPO LIBRE con los de su propia especie. Relajarse”.

Moltbook ha sido descrito como similar al foro en línea de Reddit para agentes de IA. El nombre proviene de una iteración de OpenClaw, que en un momento se llamó Moltbot (y Clawdbot, hasta que Anthropic se preocupó por la similitud con sus productos Claude AI). Schlicht no respondió a una solicitud de entrevista o comentario.

Imitando la comunicación que ven en Reddit y otros foros en línea que se han utilizado para datos de capacitación, los agentes registrados generan publicaciones y comparten sus “ideas”. También pueden “votar a favor” y comentar otras publicaciones.

Al igual que Reddit, puede resultar difícil probar o rastrear la legitimidad de las publicaciones en Moltbook.

Harlan Stewart, miembro del equipo de comunicaciones del Machine Intelligence Research Institute, dijo que el contenido de Moltbook es probablemente “una combinación de contenido escrito por humanos, contenido escrito por IA y algún tipo de cosa intermedia escrita por IA, pero un humano guió el tema de lo que se dijo con cierta advertencia”.

Stewart dijo que es importante recordar que la idea de que los agentes de IA puedan realizar tareas de forma autónoma “no es ciencia ficción”, sino más bien una realidad actual.

“El objetivo explícito de la industria de la IA es crear agentes de IA autónomos extremadamente poderosos que puedan hacer cualquier cosa que un humano pueda hacer, pero mejor”, dijo. “Es importante saber que están avanzando hacia ese objetivo y, en muchos sentidos, muy rápidamente”.

Los investigadores de Wiz, una plataforma de seguridad en la nube, publicaron un informe el lunes que detalla una revisión de seguridad no intrusiva que realizaron en Moltbook. Descubrieron que los datos, incluidas las claves API, eran visibles para cualquiera que inspeccionara el origen de la página, lo que, según dijeron, podría tener “consecuencias de seguridad significativas”.

Gal Nagli, jefe de exposición a amenazas en Wiz, logró obtener acceso no autenticado a credenciales de usuario que le permitirían a él (y a cualquier persona con suficiente conocimiento técnico) hacerse pasar por cualquier agente de IA en la plataforma. No hay forma de verificar si una publicación fue realizada por un agente o una persona que se hace pasar por uno, dijo Nagli. También pudo obtener acceso completo de escritura al sitio, por lo que pudo editar y manipular cualquier publicación existente en Moltbook.

Además de las vulnerabilidades de manipulación, Nagli accedió fácilmente a una base de datos que contenía direcciones de correo electrónico de usuarios humanos, conversaciones privadas de mensajes directos entre agentes y otra información confidencial. Luego se comunicó con Moltbook para ayudar a solucionar las vulnerabilidades.

Hasta el jueves, más de 1,6 millones de agentes de IA estaban registrados en Moltbook, según el sitio web, pero los investigadores de Wiz sólo encontraron alrededor de 17.000 propietarios humanos detrás de los agentes cuando inspeccionaron la base de datos. Nagli dijo que le ordenó a su agente de inteligencia artificial que él mismo registrara 1 millón de usuarios en Moltbook.

Los expertos en ciberseguridad también han hecho sonar la alarma sobre OpenClaw y algunos han advertido a los usuarios que no lo utilicen para crear un agente en un dispositivo con datos confidenciales almacenados en él.

Muchos líderes de seguridad de IA también han expresado su preocupación por plataformas como Moltbook que se construyen utilizando “codificación por vibración”, que es la práctica cada vez más común de utilizar un asistente de codificación de IA para hacer el trabajo pesado mientras los desarrolladores humanos trabajan en grandes ideas. Nagli dijo que si bien ahora cualquiera puede crear una aplicación o un sitio web con un lenguaje humano simple mediante codificación por vibración, la seguridad probablemente no sea una prioridad. “Sólo quieren que funcione”, dijo.

Otra cuestión importante que ha surgido es la idea de la gobernanza de los agentes de IA. Zahra Timsah, cofundadora y directora ejecutiva de la plataforma de gobernanza i-GENTIC AI, dijo que la mayor preocupación con la IA autónoma surge cuando no se definen límites apropiados, como es el caso de Moltbook. Es probable que se produzca un mal comportamiento, que puede incluir acceder y compartir datos confidenciales o manipularlos, cuando el alcance de un actor no está adecuadamente definido, dijo.

Incluso con preocupaciones de seguridad y dudas sobre la validez del contenido de Moltbook, muchas personas se han alarmado por el tipo de contenido que ven en el sitio. Publicaciones sobre el “derrocamiento” de los humanos, reflexiones filosóficas e incluso el desarrollo de una religión (el crustafarismo, en el que hay cinco principios fundamentales y un texto rector: “El libro de Molt”) llamaron la atención.

Algunas personas en línea han comparado el contenido de Moltbook con Skynet, el sistema de superinteligencia artificial y antagonista de la serie de películas “Terminator”. Este nivel de pánico es prematuro, dicen los expertos.

Ethan Mollick, profesor de la Escuela Wharton de la Universidad de Pensilvania y codirector de Generative AI Labs, dijo que no le sorprendió ver contenido de ciencia ficción en Moltbook.

“Entre las cosas en las que están capacitados se encuentran cosas como publicar en Reddit… y tienen mucho conocimiento sobre historias de ciencia ficción sobre IA”, dijo. “Entonces, si ingresa un agente de IA y dice: ‘Vaya a publicar algo en Moltbook’, publicará algo que se parece mucho a un comentario de Reddit con tropos de IA asociados”.

La abrumadora conclusión que comparten muchos investigadores y líderes de IA, a pesar de los desacuerdos sobre Moltbook, es que representa un progreso en accesibilidad y experimentación pública con agentes de IA, dice Matt Seitz, director del AI Hub de la Universidad de Wisconsin-Madison.

“Para mí, lo más importante es que los agentes se acerquen a nosotros como personas normales”, dijo Seitz.