Hoy, OpenAI lanzó GPT-5.2elogiando su mayor desempeño en materia de seguridad en lo que respecta a la salud mental.

“Con este lanzamiento, continuamos nuestro trabajo para fortalecer las respuestas de nuestros modelos en conversaciones delicadas, con mejoras significativas en la forma en que responden a indicaciones que indican signos de suicidio o autolesión, problemas de salud mental o dependencia emocional del modelo”. Publicación del blog de OpenAI estados.

Abierto AI Recientemente ha sido blanco de críticas y demandas, que acusan a ChatGPT de contribuir al psicosis, paranoia y delirios. Algunos de estos usuarios se suicidaron después de largas conversaciones con el chatbot de IA, que tenía un problema de adulación bien documentado.

En respuesta a una demanda por muerte por negligencia relacionada con el suicidio de Adam Raine, de 16 añosOpenAI negó que LLM fuera responsable, afirmó que ChatGPT dirigió al adolescente a buscar ayuda para sus pensamientos suicidas y afirmó que el adolescente “ha hecho un mal uso” de la plataforma. Al mismo tiempo, OpenAI comprometido a mejorar la forma en que ChatGPT responde cuando los usuarios muestran señales de advertencia de autolesiones y crisis de salud mental. cuantos usuarios desarrollar conexiones emocionales con chatbots de IA Al igual que ChatGPT, las empresas de inteligencia artificial se enfrentan a un escrutinio cada vez mayor sobre las salvaguardas que tienen para proteger a los usuarios.

Ahora, OpenAI afirma que sus últimos modelos ChatGPT ofrecerán “menos respuestas indeseables” en situaciones delicadas.

Velocidad de la luz triturable

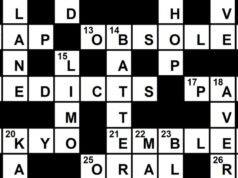

En la publicación del blog que anuncia GPT-5.2, OpenAI afirma que GPT-5.2 obtiene puntuaciones más altas en pruebas de seguridad relacionadas con la salud mental, la confianza emocional y las autolesiones en comparación con los modelos GPT-5.1. Anteriormente, OpenAI dijo que está utilizando “finalización segura”, una Nuevo enfoque para la formación en seguridad. que equilibra utilidad y seguridad. Puede encontrar más información sobre el rendimiento de los nuevos modelos en el 5.2 placa del sistema.

Crédito: Captura de pantalla: OpenAI

Sin embargo, la compañía también señaló que GPT-5.2 rechaza menos solicitudes de contenido para adultos, especialmente texto sexualizado. Pero aparentemente esto no afecta a los usuarios que OpenAI sabe que son menores de edad, ya que la compañía afirma que sus protecciones de edad “parecen estar funcionando bien”. OpenAI aplica protecciones de contenido adicionales para menores, incluida la reducción del acceso a contenido que contenga violencia, sangre, desafíos virales, juegos de roles de naturaleza sexual, romántica o violenta y “estándares de belleza extremos”.

También se está desarrollando un modelo de predicción de edad, que permitirá a ChatGPT estimar la edad de sus usuarios para ayudar a proporcionar contenido más apropiado para la edad de los usuarios más jóvenes.

A principios de este otoño, se presentó OpenAI controles parentales en ChatGPTincluido el seguimiento y la restricción de determinados tipos de uso.

OpenAI no es la única empresa de inteligencia artificial acusada de empeorar los problemas de salud mental. El año pasado, un madre demandó a Character.AI después de la muerte de su hijo por suicidio, y otra demanda afirma los niños resultaron gravemente heridos por los “personajes” de esta plataforma. Character.AI ha sido declarado inseguro para adolescentes por expertos en seguridad en línea. De manera similar, se han declarado chatbots de IA de varias plataformas, incluida OpenAI. inseguro para la salud mental de los adolescentes según expertos en seguridad infantil y salud mental.

Si tiene sentimientos suicidas o experimenta una crisis de salud mental, hable con alguien. Puede llamar o enviar un mensaje de texto al 988 Suicide & Crisis Lifeline al 988 o chatear en 988lifeline.org. Puede comunicarse con Trans Lifeline llamando al 877-565-8860 o con Trevor Project al 866-488-7386. Envíe “START” a la línea de texto de crisis al 741-741. Comuníquese con la línea de ayuda de NAMI al 1-800-950-NAMI, de lunes a viernes, de 10 a. m. a 10 p. m. ET, o por correo electrónico [email protected]. Si no te gusta el teléfono, considera usar el 988 Chat de línea de vida de crisis y suicidio. Aquí hay uno lista de recursos internacionales.

Divulgación: Ziff Davis, la empresa matriz de Mashable, presentó una demanda contra OpenAI en abril, alegando que infringió los derechos de autor de Ziff Davis en el entrenamiento y operación de sus sistemas de IA.